AIに依存して新しいタスクを学習するロボットは、通常、面倒で反復的なトレーニングプロセスを必要とします。 カリフォルニア大学バークレー校の研究者は、ロボットがゼロから始めるのではなく、ギャップを埋める革新的な学習技術を使用して、それを単純化および短縮しようとしています。

チームはTechCrunchといくつかの仕事を共有し、今日のTC Sessions:Roboticsで発表しました。以下のビデオでは、それらについて聞くことができます—最初はカリフォルニア大学バークレー校の研究者StephenJamesからです。

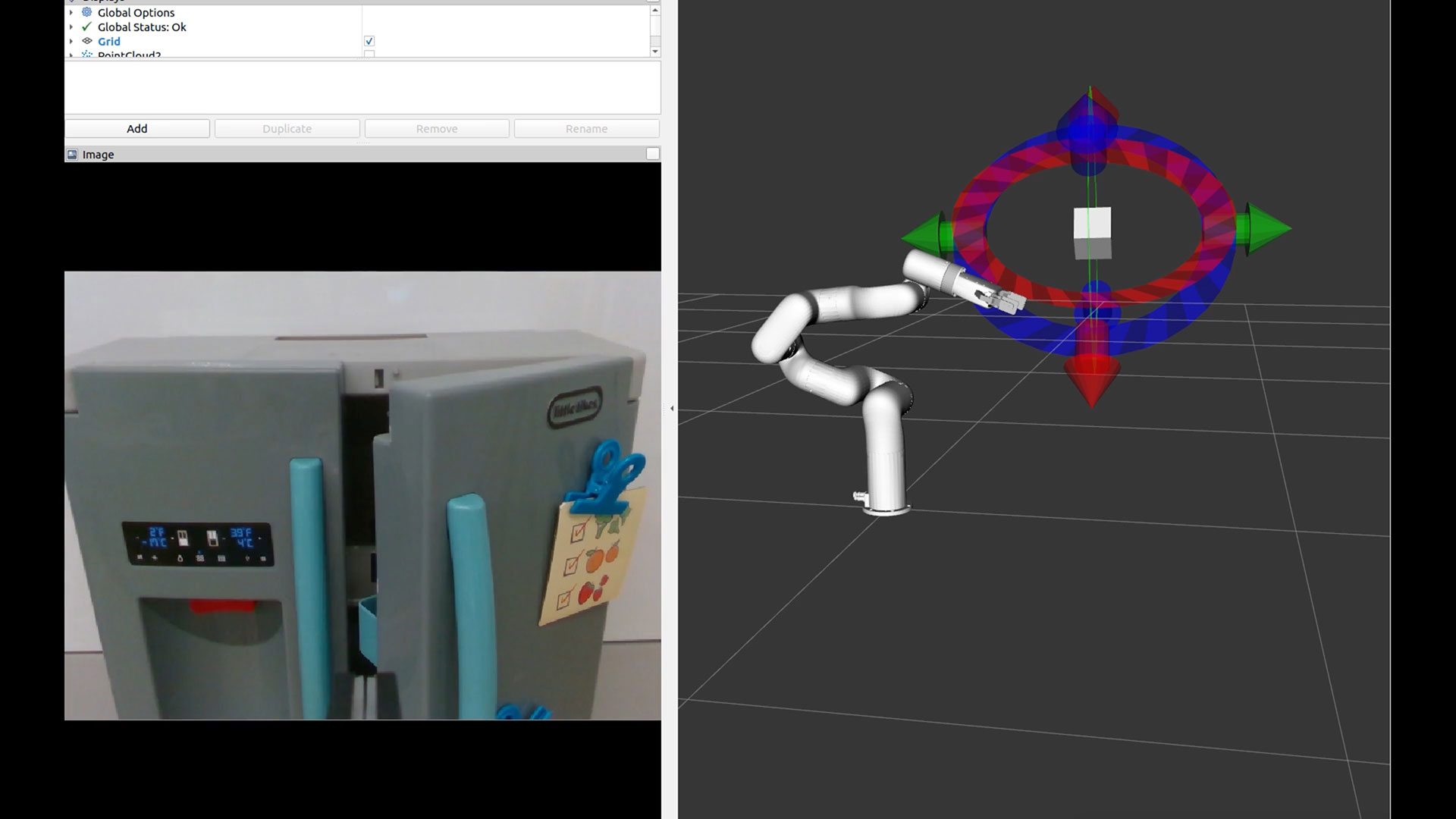

「私たちが採用している手法は、一種の対照的な学習設定であり、YouTubeビデオを取り込み、一連の領域にパッチを適用します。ロボットがその画像を再構築しようとしているという考えです」とJames説明した。 「パッチの背後にあるもののアイデアを生成するには、それらのパッチに何が含まれている可能性があるかを理解する必要があります。 世界で何が起こっているのかを本当によく理解する必要があります。」

もちろん、それは人間の世界で一般的であるように、YouTubeを見ることから学ぶだけではありません。 オペレーターは、ロボット自体を物理的に、またはVRコントローラーを介して動かして、ロボットが何をしようとしているのかを大まかに把握する必要があります。 この情報を、ビデオ画像の入力から収集した世界のより広い理解と組み合わせ、最終的には他の多くのソースも統合する可能性があります。

ジェームズ氏は、このアプローチはすでに成果を上げています。「通常、新しいタスクを実行するのに数百のデモが必要になることがありますが、今では少数のデモ、おそらく10のデモを提供でき、タスクを実行できます。」

画像クレジット: TechCrunch

Alejandro Escontrelaは、動物、人、その他のロボットの動きなど、YouTube動画から関連データを抽出するモデルの設計を専門としています。 ロボットはこれらのモデルを使用して、特定の動きが試してみるべきもののように見えるかどうかを判断して、自身の動作を通知します。

最終的には、ビデオから動きを複製しようとするため、ビデオを見ている別のモデルは、それがロボットなのか、そのボールを追いかけている本物のジャーマンシェパードなのかを判断できません。

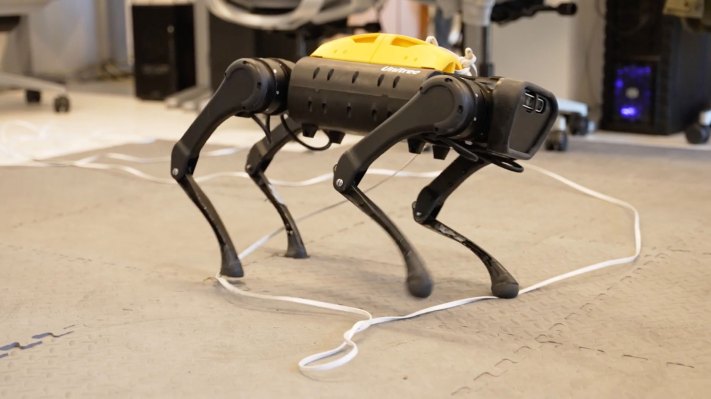

興味深いことに、このような多くのロボットは、シミュレーション環境で最初に学習し、基本的にVRで動きをテストします。 しかし、Danijar Hafnerが説明するように、プロセスは十分に効率的になっているため、そのテストをスキップして、ロボットを現実の世界で歩き回らせ、歩行、つまずき、そしてもちろんプッシュなどの相互作用からライブで学習することができます。 ここでの利点は、シミュレータに戻って新しい情報を統合する必要がなく、作業中に学習できるため、タスクがさらに簡素化されることです。

「ロボット学習の聖杯は、現実の世界でできるだけ多く、できるだけ早く学ぶことだと思います」とハフナー氏は言います。 彼らは確かにその目標に向かって動いているようです。 チームの仕事の完全なビデオをチェックしてください ここ。