不快なアイデアの壮大で長いリストの中で、AI ヒトラーとの「楽しくてインタラクティブな」会話に参加する機能を有料化することは、一番上に上がらないかもしれません。 しかし、それは間違いなくそこにあります。

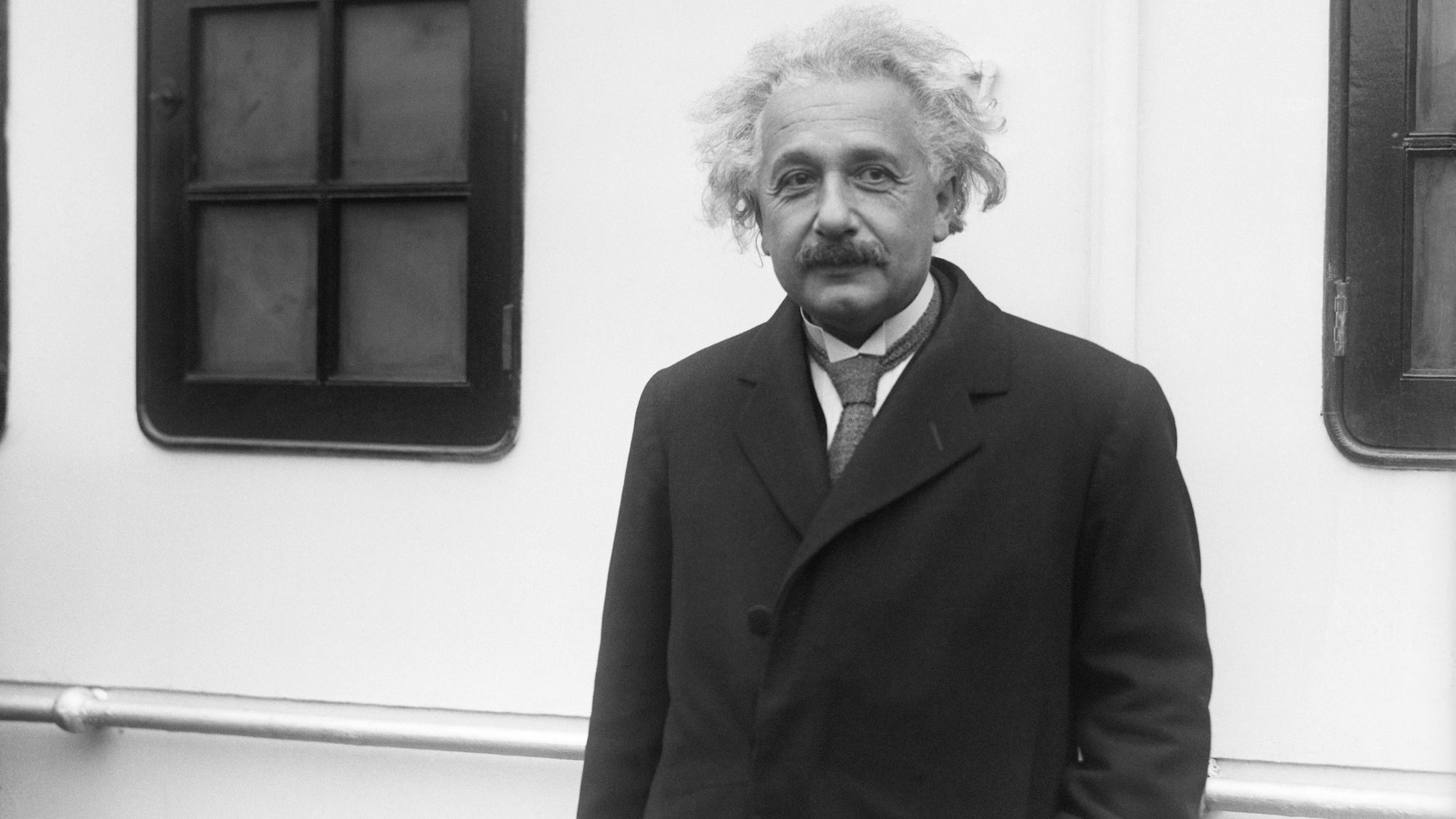

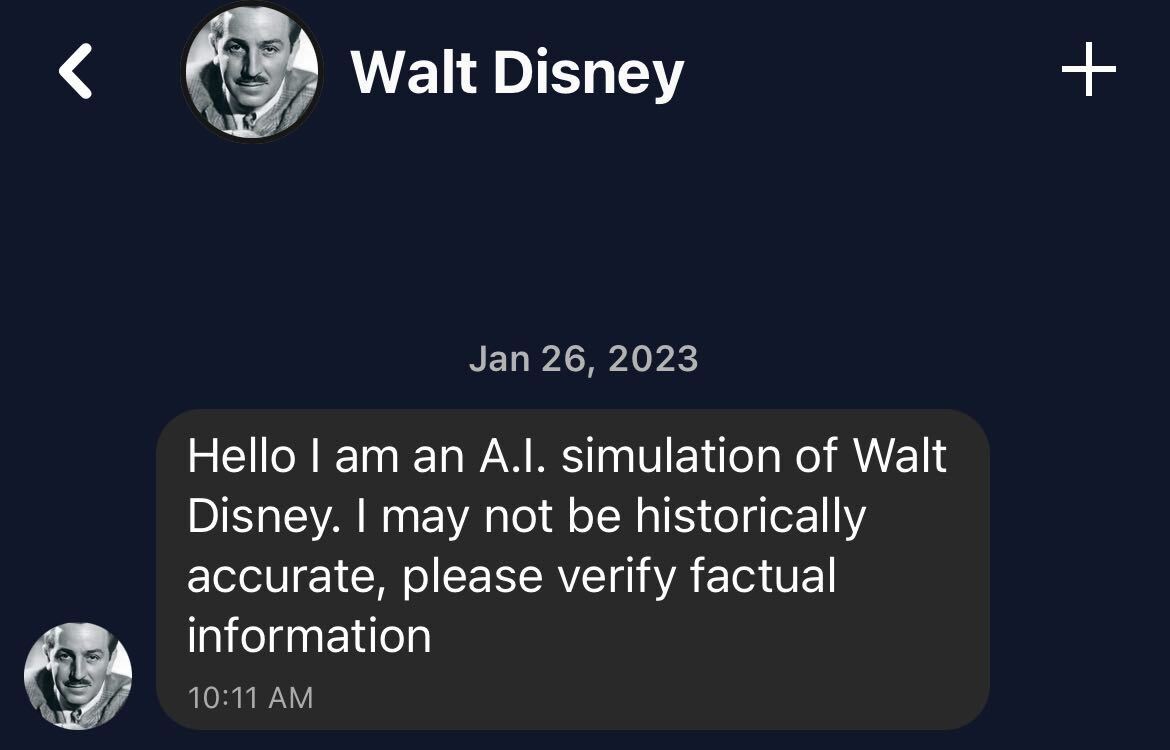

それでも、数え切れないほどの人々がチャットボットアプリを介してすでに試しています 歴史上の人物. このプロジェクトは、現在も Apple の App Store で入手できます。 ウイルスにかかった 先週、ガンジー、アインシュタイン、ダイアナ妃、チャールズ マンソンなど、AI プロファイルの網羅的で頻繁に物議を醸すリストが公開されました。 9 歳以上のすべての人に適した教育アプリ (この記事の執筆時点で、このカテゴリで 76 番目に人気のあるアプリ) であると自負しているにもかかわらず、批評家は、 すぐに嘲笑された 急ぎのアイデアとして、 頻繁に不正確なギミック せいぜい、最悪の場合、 シニカルなレバレッジ 急成長の、 すでに悩まされている という技術 チャットGPT.

[Related: Building ChatGPT’s AI content filters devastated workers’ mental health, says new report.]

平 シダント・チャッダアプリを構築した 25 歳の Amazon ソフトウェア開発エンジニアは、次のように認めています。 転がる石 先週、ChatGPT の信頼性と不正確さは、それが吐き出すと想定される事実が情報源であると誤って信じている可能性のあるユーザーにとって「危険な組み合わせ」である. 「このアプリは限られたデータを使用して、会話がどのように見えたかを最もよく推測します」と、アプリのホームページのメモを読みます. チャダは応答しませんでした ポップサイエンスさんのコメント依頼。

一部の歴史家は、その感情を激しく反映しています。 エカテリーナ・バビンツェワ、パデュー大学の技術史を専門とする助教授。 彼女にとって、ChatGPT を歴史教育に使用しようとする試みは無味であるだけでなく、根本的に害を及ぼす可能性さえあります。

「ChatGPT が作成されたときの私の最初の考えは、『ああ、これは実際には危険だ』ということでした」と彼女は Zoom について語ります。 Babintseva にとって、危険は代わりにあまり存在しません。 学術盗作の心配、そして AI が社会や文化に与えるより大きな影響については、さらに詳しく説明しています。 「ChatGPT は、情報の重要な関与の能力と、知識がどのように構築されるかを理解する能力を根絶するためのもう 1 つのレベルです。」 彼女はまた、民間企業による現在の主要な AI 開発のあいまいな性質を指摘し、知的財産をしっかりと利益を上げ続けることに関心を持っています。

[Related: CEOs are already using ChatGPT to write their emails.]

「ChatGPT は、この知識がどこから来たのかさえ説明していません。 ソースをブラックボックス化します」と彼女は言います。

ChatGPT の背後にある開発者である OpenAI、ひいては歴史上の人物などのサードパーティのスピンオフが多くのことを行っていることに注意することが重要です。 その研究 と 基本設計 誰でも受験可能。 しかし、AI の理解を訓練するために使用する膨大なインターネット テキスト リポジトリを詳細に理解することは、はるかに複雑です。 平 ChatGPT に情報源の引用を依頼する ウィキペディアのように、「公開されている情報源」よりも具体的なものを提供することができません。

そのため、チャッダの歴史上の人物アプリのようなプログラムは、歪んだ、時には完全に間違った物語を提供する一方で、その物語がそもそもどのように構築されたかを説明することさえできていません. それを歴史的な学術論文や日常のジャーナリズムと比較してください。 「歴史がある。 1 つの物語はありません」と Babintseva 氏は言います。 「単一の物語は全体主義国家にのみ存在します。なぜなら、彼らは1つの物語を作ることに本当に投資し、承認された政党の路線から逸脱した物語を作りたいと思っている人々の物語を減らしているからです。」

いつもこうだったわけではありません。 90年代後半まで、人工知能の研究は「説明可能なAI」、クリエイターは、心理学者、遺伝学者、医師などの人間の専門家がどのように決定を下すかに焦点を当てています。 しかし、1990 年代の終わりまでに、AI 開発者はこの哲学から離れ始め、実際の目標とはほとんど無関係であると見なしました。 代わりに、彼らはニューラル ネットワークを追求することを選択しました。ニューラル ネットワークは、自社の設計者でさえ完全に説明できない結論に達することがよくあります。

[Related: Youth mental health service faces backlash after experimenting with AI-chatbot advice.]

Babintseva と仲間の科学技術研究者は、少なくとも人間の生活や行動に実際に影響を与えるシステムについては、説明可能な AI モデルに戻ることを強く求めています。 AI は研究や人間の思考に取って代わるものではなく、それらを支援するべきであると彼女は言い、全米科学財団などの組織が、この方向の研究に資するフェローシップや助成金プログラムを推進することを望んでいます。

それまでは、歴史上の人物のようなアプリが今後も登場し続ける可能性が高く、それらはすべて曖昧な論理と不明確なソースに基づいており、新しい革新的な教育的代替手段として宣伝されています. さらに悪いことに、ChatGPT のようなプログラムは、こうした声を認めずに知識基盤を作成するために、人間の下請け労働に依存し続けます。 「この知識は、複数の複雑な人間の経験と理解の産物ではなく、ある種のユニークで不気味な AI の声として表されます」とバビンツェバは言います。

[Related: This AI verifies if you actually LOL.]

結局、専門家は、歴史上の人物は最新のデジタル パーラー トリックにすぎないと見なすべきだと警告しています。 ダグラス・ラシュコフは著名な未来学者であり、最近では 最も裕福な人々の生存: ハイテク億万長者のファンタジーからの脱出、PopSciへの電子メールでアプリへの銀色の人工裏地を見つけようとしました. 「まあ、私は AI を使って…死者についてのアイデアを試してみたいと思います。 [rather] 生活を置き換えるよりも。 少なくともそれは、他の方法ではできないことです。 しかし、登場人物の選択は、人々にヒトラーを直接体験させるというよりも、ニュースを生み出すように設計されているようです」と彼は書いています。

「そして、あなたが私にコメントを求めてメールを送った方法を見ると、スタントがうまくいったようです!」