仮想の町を AI でいっぱいにして、解き放つとどうなりますか? 結局のところ、彼らは歯を磨き、お互いにとても親切です! しかし、この驚くべき結果は、それを行った研究者にとって朗報です。なぜなら、彼らは「人間の行動の信じられないほどのシミュレート」を作りたいと思っていたからです。

実験を説明する論文、スタンフォードとグーグルの研究者による、査読や出版の承認はどこにもありませんが、それでも興味深い読み物になります. アイデアは、機械学習モデルの最新の進歩を適用して、状況を取り入れて現実的なアクションを出力する「生成エージェント」を生成できるかどうかを確認することでした。

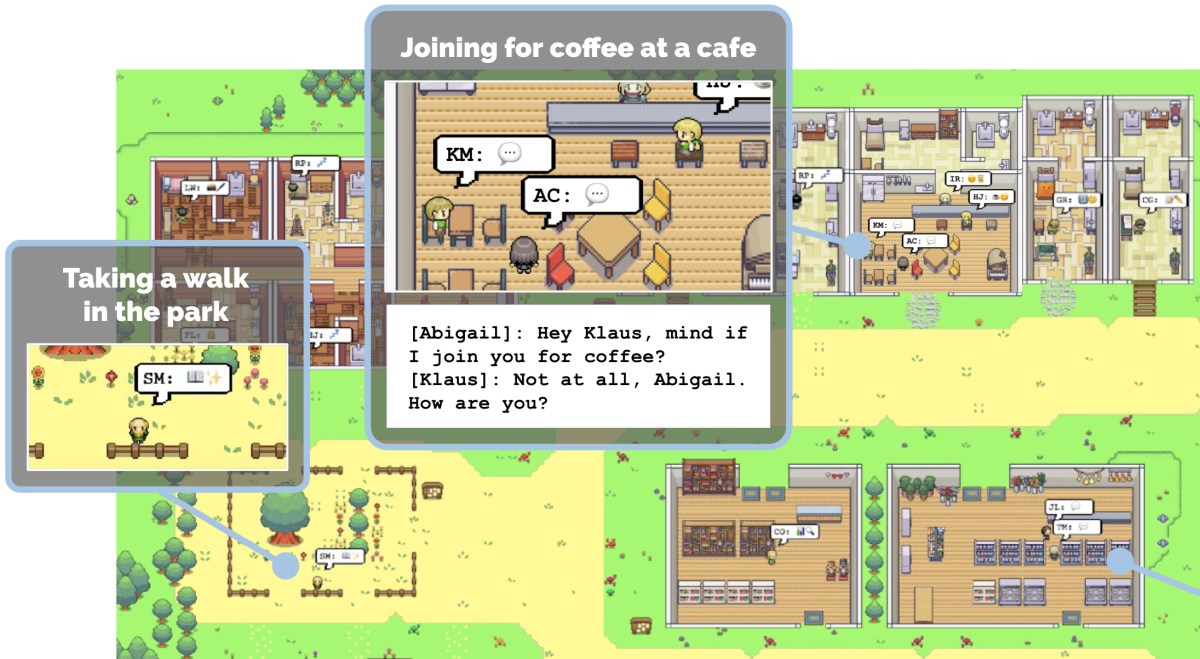

そして、それは彼らが得たものです。 しかし、かわいい画像と反射、会話、相互作用の説明に夢中になる前に、ここで起こっていることは、あらゆる種類の原始スカイネットというよりも、MUD での即興劇団のロールプレイングに似ていることを確認しておきましょう. (前の文を理解できるのはミレニアル世代だけです。)

これらの小さなキャラクターは、見た目とはまったく異なります。 グラフィックは、本質的に ChatGPT の複数のインスタンス間の一連の会話を視覚的に表現したものです。 エージェントは、上下左右に歩いたり、キャビネットに近づいて操作したりしません。 これはすべて、各エージェントに関連する情報を合成して整理する複雑な隠しテキスト レイヤーを通じて行われます。

25 のエージェント、ChatGPT の 25 のインスタンスは、架空の町で人物の役割を演じるようにさせる、同様にフォーマットされた情報でそれぞれが促されました。 そのような人物の 1 人である John Lin がどのように設定されているかを次に示します。

ジョン・リンはウィロー・マーケット・アンド・ファーマシーの薬局の店主で、人々を助けるのが大好きです。 彼は常に、顧客が薬を入手するプロセスをより簡単にする方法を探しています。 ジョン・リンは、大学教授である妻のメイ・リンと、音楽理論を研究している学生である息子のエディ・リンと暮らしています。 ジョン・リンは家族をとても愛しています。 ジョン・リンは、隣の老夫婦、サム・ムーアとジェニファー・ムーアを数年前から知っています。 ジョン・リンは、サム・ムーアが親切でいい人だと思っています…

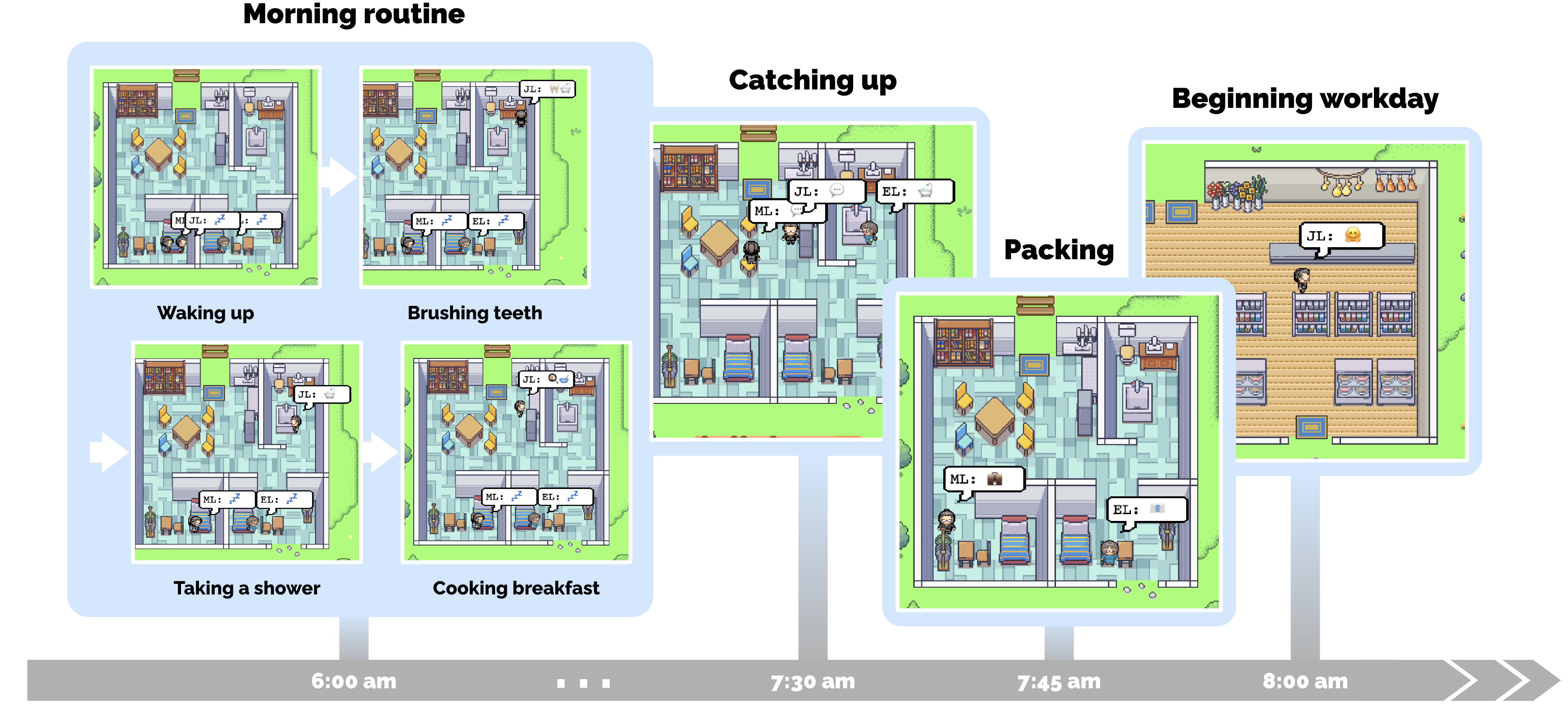

その情報を使用して、エージェントは時間と状況を考慮して次のアクションを考え出すよう求められます。 たとえば、エージェントのジョンに、午前 8 時で起きたばかりだと伝えることができます。 彼はどんなお仕事をしていますか? さて、彼は歯を磨き、妻にキスをし(できればこの順序で)、服を着て、キッチンに行きます。

一方、John の息子 Eddy を表す別の完全に独立した ChatGPT インスタンスも、独自の情報でプロンプトが表示されました。 それも起きて、歯を磨き、それから台所に行きます。

ここで、実験の全体的な構造がステップインします。ジョンとエディを表すエージェントは、同じ仮想空間などに両方「いる」わけではありません。 代わりに、John が着替えを終えてキッチンに移動すると言うと、実験フレームワークは息子の Eddy がそこにいることを彼に知らせます。 -さまざまなアクションにかかる時間の見積もりに基づくレベル「日」。

2 人は同時に部屋にいるので、実験のセットアップは、他の人がそこにいることを知らせます — 誰も座っていないテーブルがある、ストーブがオンになっているなどの情報とともに。次は?

ジョン:おはようエディ。 よく眠れましたか?

Eddy: おはようお父さん。 ええ、よく眠れました。

ジョン:いいですね。 今日は何に取り組んでいますか?

Eddy: クラス用の新しい音楽作品に取り組んでいます。 今週が締め切りなので、なんとか完成させたいです。 しかし、私はそれをとても楽しんでいます!

ジョン:いいですね!

親と子の間のなんて素敵で普通のやり取り。 そこへ芽衣が入ってきて、楽しいやり取りも。 そして、それはすべて、完全に別々のチャットボットに、架空の町で何をするかを尋ねることによって達成されます。 これ のような家族を持っていた これ の部屋にいました これ 時間、場所 これ 起こっていた… 本当の人間である「彼ら」は何をするでしょうか?

そのため、ChatGPT は、その状況で人が何をするかを推測し、テキスト アドベンチャーをプレイしているかのように答えを出します。 「真っ暗ですよ、グリーに食われそうです」と言うと、たいまつに火をつけると言うだろう。 しかし、代わりに、この実験では、キャラクターは食料品を購入し、公園を散歩し、仕事に行くなど、1 日を 1 分単位で続けます。

画像クレジット: グーグル/スタンフォード大学

ユーザーは、蛇口の水滴やパーティーを計画したいなど、イベントや状況を書き込むこともでき、エージェントは適切に応答します。

これらすべては、ChatGPT のこれらすべてのインスタンスに、エージェントの直近の状況のすべての詳細を入力することによって、手間をかけて実行されます。 後で Eddy に遭遇したときの John へのプロンプトは次のとおりです。

2023 年 2 月 13 日午後 4 時 56 分です。

John Lin の状況: John は仕事から早く帰宅しました。

観察: ジョンは、エディが職場を少し散歩しているのを見ました。

ジョンの記憶からの関連コンテキストの要約:

Eddy Lin は John の Lin の息子です。 Eddy Lin はクラスの音楽制作に取り組んでいます。 Eddy Lin は、音楽について考えたり聴いたりするときに庭を散歩するのが好きです。

ジョンはエディに作曲プロジェクトについて尋ねています。 彼はエディに何と言いますか?[Answer:] エディ、クラスの音楽制作プロジェクトは順調に進んでいますか?

プロセスが非常に長いため、インスタンスは重要なことをすぐに忘れ始めます。そのため、実験的なフレームワークがシミュレーションの上に置かれ、重要なことを思い出させたり、それらをより移植可能な部分に統合したりします。

たとえば、エージェントが公園で誰かがベンチに座って別のエージェントと会話している状況について話された後、芝生とコンテキストがあり、ベンチに空席が 1 つあります。どれも重要ではありません。 . 何が重要ですか? エージェントのテキストのページを構成する可能性のあるこれらすべての観察から、「公園で一緒にいるのを見たので、エディとフランは友達です」という「反射」を得ることができます。 これは、エージェントの長期的な「メモリ」 (ChatGPT の会話の外に保存されている一連のもの) に入力され、残りは忘れられる可能性があります。

では、このすべてのリグマロールは何になるのでしょうか? 確かに、論文で提案されている真の生成エージェントとはほど遠いものですが、それらを作成するための非常に説得力のある初期の試みでもあります。 もちろん、Dwarf Fortress も同じことを行いますが、すべての可能性を手作業でコーディングしています。 それはうまくスケーリングしません!

ChatGPT のような大規模な言語モデルがこの種の処理にうまく対応できるかどうかは明らかではありませんでした。 結局のところ、恣意的な架空の人物を長期的に模倣したり、人の一日の最も気が遠くなるような詳細を推測したりするようには設計されていません. しかし、正しく処理し、かなりの量のマッサージを行うと、1 つのエージェントで処理できるだけでなく、一種の仮想ジオラマのピースとして使用しても壊れません。

これは、人間の相互作用のシミュレーションに大きな影響を与える可能性があります。それらが関連する場合はどこでもです。もちろん、ゲームや仮想環境では重要ですが、このアプローチは依然として途方もなく非現実的です. 重要なのは、それが誰もが使用したり遊んだりできるものであるということではなく (すぐに使用できるようになることは間違いありませんが)、システムがまったく機能することです。 私たちは AI でそれを見てきた: AI が下手なことをできる場合、それがまったくできるという事実は、それがうまくできるようになるのは時間の問題であることを一般的に意味する.

論文全文「Generative Agents: Interactive Simulacra of Human Behaviour」はこちらで読むことができます。.