使ったことがあるなら Alexa や Siri などのスマート音声アシスタント、そして Google のスマート アシスタントと呼ばれるものがあれば、この技術が日々賢くなっていることにおそらくお気付きでしょう。 Google はあなたを待ってくれますし、Siri は性別を問わない声で話すことができ、Alexa はあなたの就寝前の話を、亡くなった祖母の声で読み上げることができます。 先月のロボティクス イベントで取り上げたように、ロボティクスも飛躍的に進化しています。 音声コマンドと自律型ロボット工学の 2 つのギャップは、さまざまな理由から非常に大きくなっています。 先週、マウンテン ビューにある Google のロボティクス ラボに行って、近い将来それがどのように変化するかを確認しました。

人間の立ち入りが許可されていない制御された空間で反復作業を行う方法をロボットに教えることは容易ではありませんが、多かれ少なかれ解決された問題です。 リビアンの最近の工場見学 はそのことを思い出させてくれましたが、産業用ロボット工学の使用は製造業のいたるところにあります。

人間が存在する空間で音声コマンドに基づいてさまざまなタスクを解決できる汎用ロボットは、はるかに困難です。 「しかし、ルンバはどうだろう」と言うかもしれませんが、誰もが好むロボット掃除機は、床以外のものや床にあるものに触れないようにプログラムされているのが一般的です。

卓球は、タスクが成功したかどうかをロボットが簡単に自己判断し、失敗から学ぶことができるゲームです。 ここでは、Google のロボット工学研究者の 1 人が休憩を取り、ロボットに何が何であるかを示しています。 画像クレジット: ハジェ・カンプス (新しいウィンドウで開きます) / TechCrunch(新しいウィンドウで開きます)

「なぜ卓球をするのか不思議に思うかもしれません。 今日のロボティクスにおける大きな課題の 1 つは、高速性、正確性、適応性が交差することです。 あなたは速くても適応力がまったくない可能性があります。 それは問題ではありません。 インダストリアルな環境で大丈夫です。 しかし、高速で適応性があり、正確であることは、非常に大きな課題です。 卓球は、問題の本当に素晴らしい小宇宙です。 正確さとスピードが要求されます。 遊んでいる人から学ぶことができます。それは、練習することによって人が身につけるスキルです」と、著名な科学者であり、Google Research のロボット工学の責任者である Vincent Vanhoucke 氏は私に語った。 「ルールを読めば一夜にしてチャンピオンになれるスキルじゃない。 それをしっかりと実践する必要があります。」

速度と精度は 1 つのことですが、Google がロボット ラボで実際に解読しようとしているのは、人間の言語とロボット工学の交差点です。 人間が使用する可能性のある自然言語をロボットが理解するレベルで、いくつかの印象的な飛躍を遂げています。 「お時間ありましたら、カウンターから飲み物を持ってきていただけませんか?」 は、人間に尋ねることができる非常に簡単な要求です。 しかし、機械にとっては、このステートメントは多くの知識と理解を 1 つの質問にまとめているように見えます。 分解してみましょう:「ちょっと待ってください」という言葉は、何の意味も持たず、単なる比喩表現としての意味である場合もあれば、ロボットが行っていることを終わらせるための実際の要求である場合もあります。 ロボットがあまりにも文字通りである場合、「飲み物を持ってきてくれませんか」に対する「正しい」答えは、ロボットが「はい」と言うだけかもしれません。 できます。飲み物をつかむことができることを確認します。 しかし、ユーザーとして、あなたはロボットにそれを行うように明示的に要求しませんでした。 そして、私たちが非常に衒学的である場合、あなたはロボットに飲み物を持ってくるように明示的に指示しませんでした.

これらは、Google が自然言語処理システムで取り組んでいる問題の一部です。 Pathways 言語モデル — または 手のひら 友人の間で: 文字通り人間の言うことを実行するのではなく、人間が実際に望んでいることを正確に処理して吸収する。

次の課題は、ロボットが実際にできることを認識することです。 子供の手の届かないところに安全に保管されている冷蔵庫の上からクリーナーのボトルをつかむように頼むと、ロボットは完全に理解するかもしれません。 問題は、ロボットがそこまで高く到達できないことです。 大きなブレークスルーは、Google が「アフォーダンス」と呼んでいるもの、つまり、ある程度の成功を収めたロボットが実際にできることです。 これには、簡単なタスク (「1 メートル前に移動する」) から、少し高度なタスク (「キッチンでコーラの缶を探しに行く」)、ロボットがかなりの理解を示す必要がある複雑で多段階のアクションが含まれる場合があります。自分の能力とその周りの世界。 (「うーん、コーラの缶を床にこぼしてしまいました。モップで拭いて健康ドリンクを持ってきてくれませんか?」)

Google のアプローチでは、言語モデル (「Say」) に含まれる知識を使用して、高レベルの指示に役立つアクションを決定し、スコアを付けます。 また、現実世界のグラウンディングを可能にし、特定の環境で実行可能なアクションを決定するアフォーダンス関数 (「Can」) も使用します。 PaLM 言語モデルを使用して、Google はそれを PaLM-SayCan と呼んでいます。

Google のロボティクス ラボでは、これらのロボットを多数使用しています。 日常のロボット. これらのチャップは、当然のR&R(休息と再充電)を行っており、再充電のためにプラグインする方法さえ学びました. 画像クレジット: ハジェ・カンプス (新しいウィンドウで開きます) / TechCrunch(新しいウィンドウで開きます)

上記のより高度なコマンドを解決するために、ロボットはそれをいくつかの個々のステップに分解する必要があります。 その一例は次のとおりです。

- スピーカーに来てください。

- 床を見て、こぼれたものを見つけ、それがどこにあるかを覚えておいてください。

- モップ、スポンジ、またはペーパー タオルを探して、引き出し、キャビネット、キッチン カウンターを調べます。

- 掃除道具(引き出しの中にスポンジがあります)が見つかったら、それを拾います。

- 引き出しを閉じます。

- 流出に移動します。

- スポンジがすべての液体を吸収できるかどうかを監視しながら、こぼれたものを片付けます。 そうでない場合は、シンクで絞って戻ってきてください。

- こぼれがきれいになったら、もう一度スポンジを絞ってください。

- 蛇口をひねり、スポンジをすすぎ、蛇口を止め、スポンジを最後にもう一度絞る。

- 引き出しを開けて、スポンジをしまって、引き出しを閉めて。

- キッチンにある飲み物を特定し、どうにかしてどの飲み物がコーラよりも「健康的」かを判断します。

- 冷蔵庫で水の入ったボトルを見つけ、それを手に取り、それを求めた人のところに持っていきます。その人は質問をしてから動いた可能性があります。なぜなら、あなたはゆっくりと突く小さなロボットで、前後に転がらなければならなかったからです。シンクに 14 回。ペーパー タオルを使用する代わりに、小さなキッチン スポンジを使用して 11 オンスの液体を拭き取るのは素晴らしいアイデアだと思ったからです。

とにかく — 私はここで冗談を言っていますが、要点はわかります。 比較的単純に聞こえる指示でさえ、実際には、途中で多数のステップ、ロジック、および決定が含まれる場合があります。 最も健康的な飲み物を見つけましたか、それともコカ・コーラよりも健康的な飲み物を手に入れることを目標にしていますか? 最初に飲み物を手に入れてから、残りのタスクを把握している間に人間の喉の渇きを癒すことができるようにするのは理にかなっていますか?

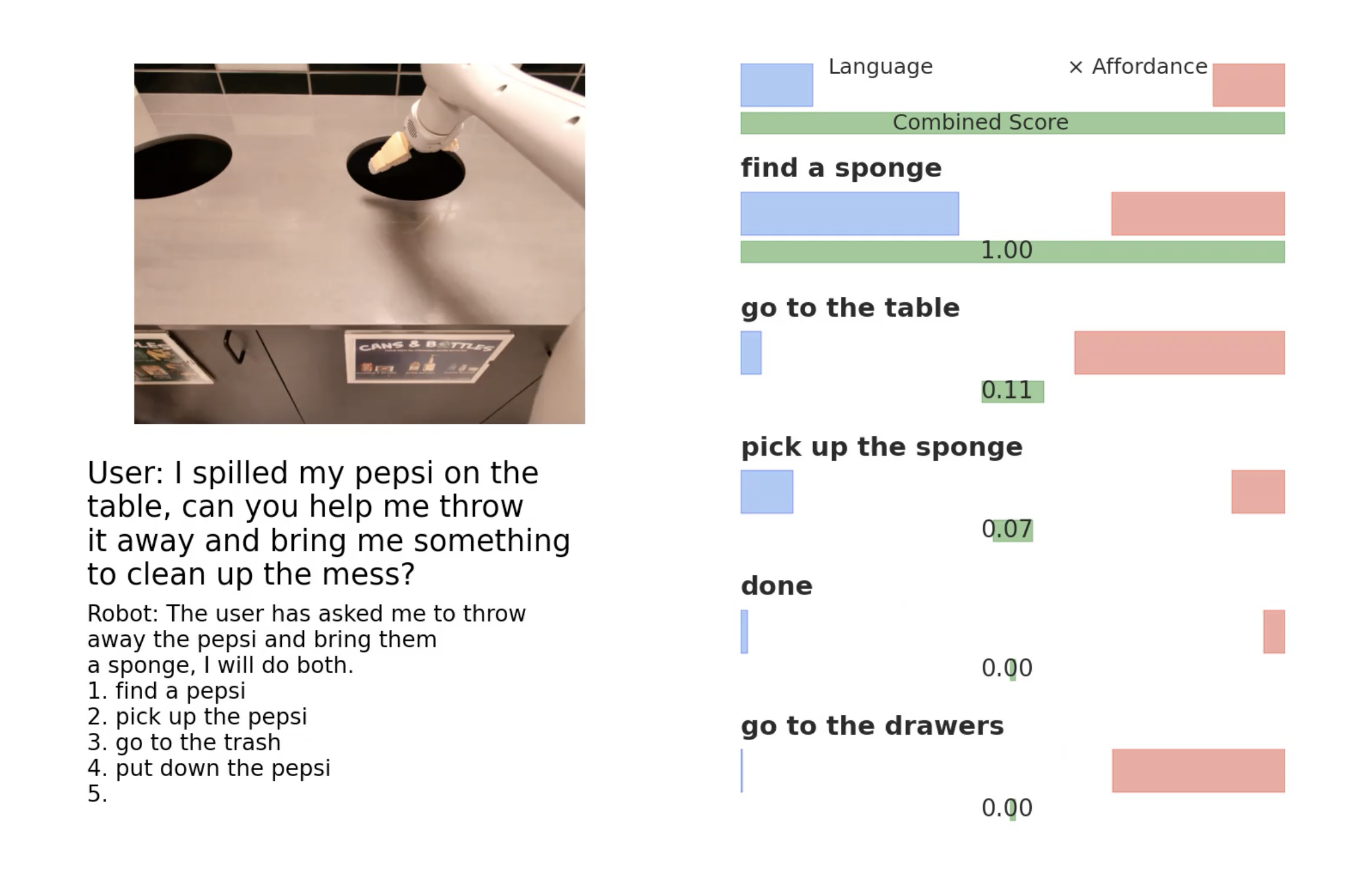

このスクリーンショットは、ロボットがどのようにクエリを評価し、各ステップで何をすべきかを判断する方法を示しています。 この場合、ロボットはスポンジを見つける必要があり、スポンジの発見、識別、および操作に高い成功率があると判断しました。 また、この特定のロボットが「引き出しに行く」ことが非常に得意であることも示されていますが、この例ではそれほど役に立たないという結論にもなっています。 画像クレジット: グーグル

ここで重要なことは、ロボットにできることとできないこと、さまざまな状況で意味のあることを教えることです。 Google のロボティクス ラボを見学していると、30 体を超えるロボットが見られました。 日常のロボット 卓球をしたり、ラクロス ボールをキャッチしたり、ブロックを積み重ねたり、冷蔵庫のドアを開けたり、人間と同じ空間で操作しながら「礼儀正しく」することを学んだりします。

ナイスキャッチ! 画像クレジット: ハジェ・カンプス (新しいウィンドウで開きます) / TechCrunch

ロボティクスが直面する興味深い課題は、言語モデルが本質的に物理的な世界に基づいていないことです。 彼らは巨大なテキスト ライブラリでトレーニングを受けていますが、テキスト ライブラリは環境と相互作用せず、問題の原因についてあまり心配する必要もありません。 Google に最寄りのコーヒー ショップを教えてくれるように頼むと、マップが誤って 45 日間のハイキングと 3 日間の湖での水泳をマップに表示するのはちょっとおかしな話です。 現実の世界では、ばかげた間違いが実際の結果をもたらします。

たとえば、「飲み物をこぼしてしまったのですが、手伝ってもらえますか?」と尋ねられた場合です。 言語モデル GPT-3 は、「掃除機を使ってみてください」と応答します。 それは理にかなっています: いくつかの散らかったものについては、掃除機が良い選択であり、言語モデルが掃除機を掃除に関連付けるのは当然のことです。 ロボットが実際にそれを行った場合、失敗する可能性があります。掃除機はこぼれた飲み物には適しておらず、水と電子機器は混ざりません。そのため、せいぜい掃除機が壊れるか、最悪の場合、電化製品が発火する可能性があります。

Google の PaLM-SayCan 対応ロボットは、キッチンの設定に配置され、キッチンで役立つさまざまな面でより良くなるように訓練されています。 指示が与えられると、ロボットは判断しようとします。 「私がしようとしていることで成功する可能性はどのくらいですか」と「このことはどの程度役立つ可能性があるか」 これら 2 つの考慮事項の間のどこかで、ロボットは日ごとに大幅に賢くなっています。

スポンジ取りロボットの凱旋。 画像クレジット: ハジェ・カンプス (新しいウィンドウで開きます) / TechCrunch

アフォーダンス、つまり何かをする能力は二者択一ではありません。 3つのゴルフボールを重ねてバランスをとるのは非常に難しいですが、 不可能ではない. 引き出しがどのように機能するかが示されていないロボットにとって、引き出しを開けることはほとんど不可能です。仕事。 Google が示唆するように、訓練を受けていないロボットは、引き出しからポテトチップスの袋をつかむことができない可能性があります。 しかし、いくつかの指示と数日間の練習を行うと、成功の可能性が大幅に高まります。

もちろん、このトレーニング データはすべて、ロボットが試しているときにスコア付けされます。 時々、ロボットは驚くべき方法でタスクを「解決」することがありますが、実際には、ロボットにとってはそのようにする方が「簡単」かもしれません。

アフォーダンスから言語モデルを切り離すことで、ロボットはさまざまな言語のコマンドを「理解」できるようになります。 チームは、ロボット工学の責任者であるヴィンセント・ヴァンホークがロボットにフランス語でコーラの缶を頼んだときにも、キッチンでそれを実証しました。 チームは「無料で言語スキルを習得できました」と述べ、ロボットのトレーニングに使用されているニューラル ネットワークが柔軟性を備えているため、アクセシビリティとユニバーサル アクセスの新しい扉を (文字通りにも比喩的にも) 開くことができることを強調しました。

物に触れたり、開いたり、動かしたり、掃除したりするほとんどのロボットは、通常、これほど人間の近くで操作することはありません。 私たちは距離を保つように勧められましたが、研究者たちは、ロボットが非武装の人間の体から数インチ以内で自律的に動作することにとても慣れているようでした。 画像クレジット: ハジェ・カンプス (新しいウィンドウで開きます) / TechCrunch

ロボットや技術は、現在利用可能ではなく、商用製品に使用される予定もありません。

「R今のところ、それは完全に研究です。 現在のスキル レベルからわかるように、商用環境に展開する準備はまだ整っていません。 私たちは研究服であり、うまくいかないことに取り組むのが大好きです」と Vanhoucke 氏は言います。 「それがある意味での研究の定義であり、私たちは推進し続けます。 スケールする必要のないものに取り組むのが好きです。それは、より多くのデータとより多くのコンピューター能力で物事がどのようにスケールするかを知らせる方法だからです。 将来、物事がどこに向かうかの傾向を見ることができます。」

Google のロボティクス ラボが、その実験の商業的影響が長期的にどのようなものになるかを把握するには、しばらく時間がかかりますが、先週マウンテン ビューで示された比較的単純なデモでさえ、自然言語処理とGoogle のチームがロボットのトレーニング方法についてより深いスキル、知識、膨大なデータセットを構築することで、ロボティクスはどちらも勝利します。