OpenAI の ChatGPT に沿った大規模言語モデル (LLM) はブラック ボックスであるとよく言われますが、確かにそれにはいくつかの真実があります。 データ サイエンティストにとっても、モデルが常にそのように応答する理由を理解するのは困難です。

LLM のレイヤーをはがす努力の中で、OpenAI は、LLM のどの部分がどの動作を担当しているかを自動的に識別するツールを開発しています。 その背後にいるエンジニアは、まだ初期段階にあると強調していますが、それを実行するためのコードは、今朝の時点で GitHub のオープン ソースで入手できます。

「私たちはしようとしています [develop ways to] AIシステムの問題がどうなるかを予測してください」と、OpenAIの解釈可能性チームマネージャーであるWilliam Saunders氏はTechCrunchの電話インタビューで語った。 「私たちは、モデルが何をしているか、そしてモデルが生成する答えを信頼できることを本当に知りたいのです。」

そのために、OpenAI のツールは (皮肉なことに) 言語モデルを使用して、他の構造的に単純な LLM (特に OpenAI 独自の GPT-2) のコンポーネントの機能を解明します。

OpenAI のツールは、LLM でニューロンの動作をシミュレートしようとします。

どうやって? まず、背景として LLM について簡単に説明します。 脳と同様に、それらは「ニューロン」で構成されており、テキスト内の特定のパターンを観察して、モデル全体が次に「言う」ことに影響を与えます。 たとえば、スーパーヒーローに関するプロンプト (例: 「最も有用なスーパーパワーを持っているスーパーヒーローは?」) が与えられた場合、「マーベル スーパーヒーロー ニューロン」は、モデルがマーベル映画の特定のスーパーヒーローを指名する確率を高める可能性があります。

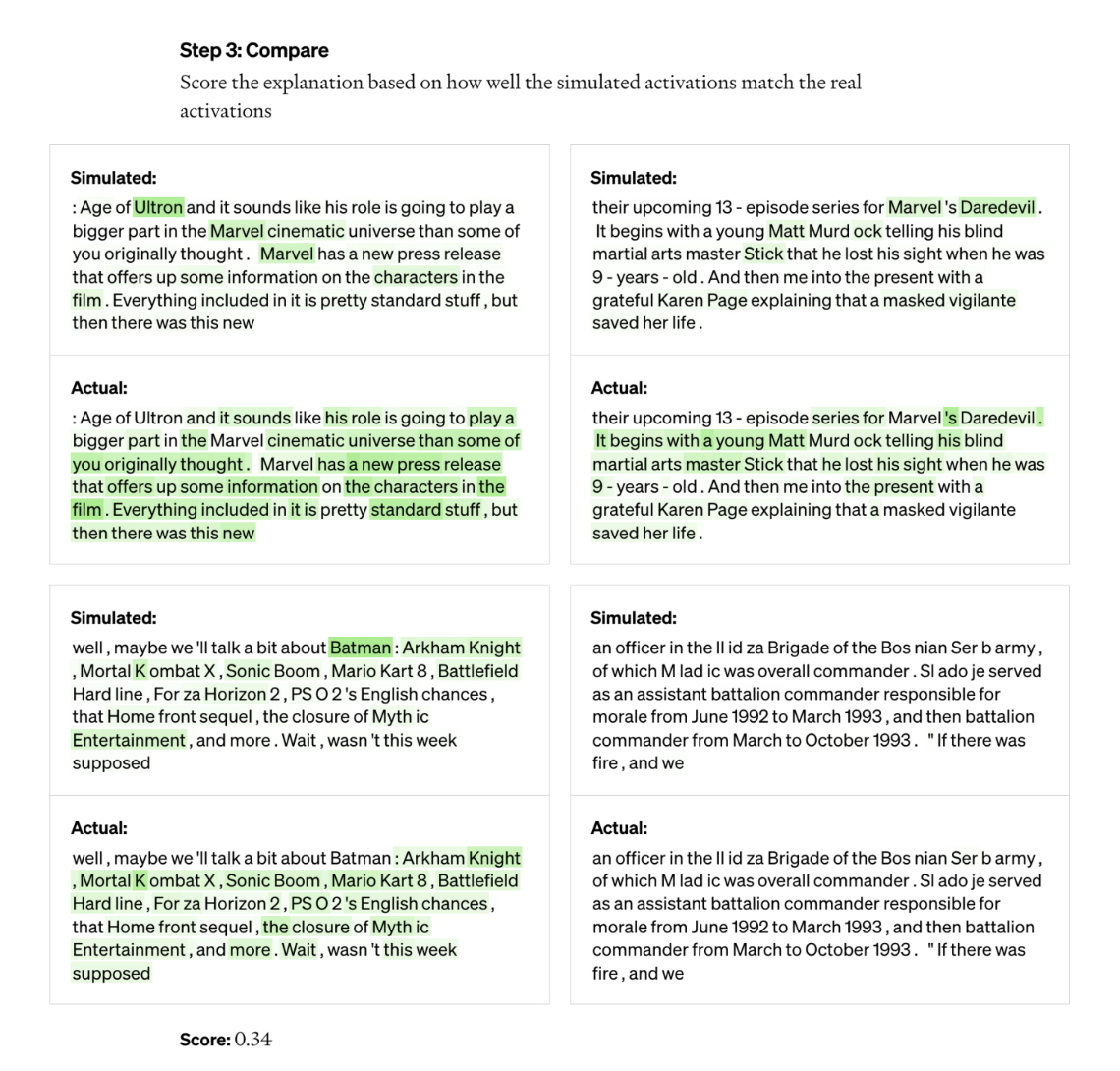

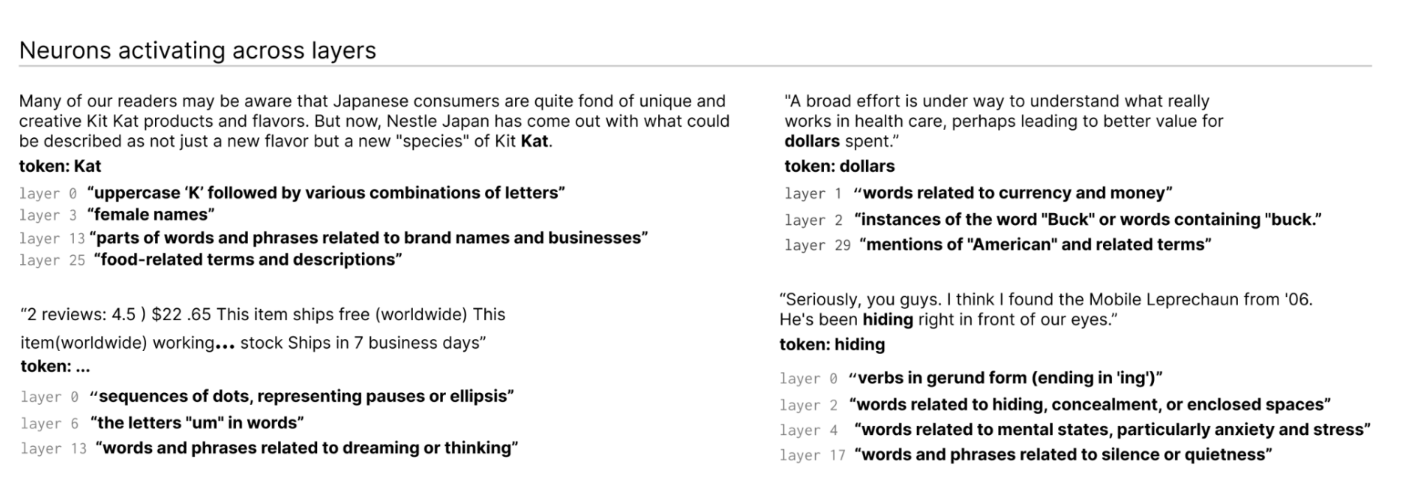

OpenAI のツールは、この設定を利用して、モデルを個々のピースに分解します。 まず、ツールは評価対象のモデルを通じてテキスト シーケンスを実行し、特定のニューロンが頻繁に「活性化」するケースを待ちます。 次に、OpenAI の最新のテキスト生成 AI モデルである GPT-4 を「表示」し、これらの非常にアクティブなニューロンと GPT-4 に説明を生成させます。 説明がどれほど正確かを判断するために、ツールは GPT-4 にテキスト シーケンスを提供し、ニューロンがどのように動作するかを予測またはシミュレートします。 次に、シミュレートされたニューロンの動作を実際のニューロンの動作と比較します。

「この方法論を使用すると、基本的に、すべてのニューロンについて、ニューロンが何をしているかについて何らかの予備的な自然言語による説明を導き出し、その説明が実際の行動とどの程度一致しているかを示すスコアを得ることができます。」 OpenAI のスケーラブルな調整チームは、次のように述べています。 「プロセスの一部としてGPT-4を使用して、ニューロンが探しているものの説明を作成し、それらの説明がニューロンが行っていることの現実とどの程度一致しているかをスコアリングしています。」

研究者は、GPT-2 の 307,200 個のニューロンすべての説明を生成することができ、ツール コードと一緒にリリースされたデータ セットにまとめました。

このようなツールは、いつか LLM のパフォーマンスを改善するために使用される可能性があると研究者は述べています。 しかし、彼らは、それが本当に役立つようになるまでには長い道のりがあることを認めています. このツールは、それらのニューロンの約 1,000 個 (全体のわずかな割合) の説明に自信を持っていました。

冷笑的な人は、GPT-4 が機能する必要があることを考えると、このツールは本質的に GPT-4 の宣伝であると主張するかもしれません。 他の LLM 解釈可能性ツールは、DeepMind のような商用 API にあまり依存していません。 トラック、プログラムをニューラル ネットワーク モデルに変換するコンパイラ。

Wu 氏は、そうではないと述べ、このツールが GPT-4 を使用しているという事実は単なる「偶然」であり、逆に、この分野における GPT-4 の弱点を示しています。 彼はまた、商用アプリケーションを念頭に置いて作成されたものではなく、理論的には GPT-4 以外の LLM を使用するように適合させることができるとも述べました。

このツールは、LLM のレイヤー全体で活性化するニューロンを識別します。

「ほとんどの説明はスコアが非常に低いか、実際のニューロンの動作の多くを説明していません」と Wu 氏は述べています。 「たとえば、ニューロンの多くは、何が起こっているのかを判断するのが非常に難しい方法で活動しています。たとえば、5 つまたは 6 つの異なるもので活動していますが、識別可能なパターンはありません。 時々そこに は 識別可能なパターンですが、GPT-4 はそれを見つけることができません。」

言うまでもなく、より複雑で新しく大規模なモデル、または Web を参照して情報を取得できるモデルについては言うまでもありません。 しかし、その 2 番目の点について、Wu は、Web ブラウジングによってツールの基本的なメカニズムが大きく変わることはないと考えています。 ニューロンが特定の検索エンジンのクエリを実行したり、特定の Web サイトにアクセスしたりする理由を解明するために、単純に微調整することができると彼は言います。

「これにより、他の人が構築して貢献できる自動化された方法で解釈可能性に対処するための有望な道が開かれることを願っています」と Wu 氏は述べています。 「ニューロンが何に反応しているかだけでなく、これらのモデルの全体的な振る舞い、つまりモデルが計算している回路の種類と、特定のニューロンが他のニューロンにどのように影響するかについて、実際に適切な説明が得られることを願っています。」