の アイフォン14 ほぼ確実に角を曲がったところにあり、発売に向けて噂が猛烈に渦巻いています. 私はとても声を上げてきました Appleの次のフラッグシップ携帯電話で見たい主な機能、しかし、私が特に熱心に見ているのは、実際の一歩を踏み出すカメラです.

Apple の携帯電話のカメラは常に素晴らしいものでした。 iPhone 13 プロ プロ仕様のカメラに期待するような写真を撮ることができ、最も安価な iPhone SE でも夏休みに美しいスナップを撮ることができます。 しかし ピクセル 6 プロ と サムスン Galaxy S22 Ultra 驚くべきカメラ システムを詰め込んでいるということは、Apple がかつてのような優位性を持っていないことを意味します。

そこで私は、iPhone 14 用に Apple のカメラ システムを再設計して、最高の写真用携帯電話としての地位を確保する方法について空想にふけっていました。 アップル、注意してください。

iPhone 14のはるかに大きなイメージセンサー

携帯電話内のイメージ センサーは、Canon EOS R5 などのプロ用カメラに搭載されているものに比べて小さいです。 イメージセンサーが小さいほど、それに当たる光が少なくなり、光が すべての 写真で。 より多くの光を取り込めるということは、特に夜間の画像の見栄えが良くなることを意味します。これが、プロのカメラが携帯電話に見られるセンサーの何倍ものサイズのセンサーを備えている理由です。

この点で電話のカメラが欠けているのはなぜですか? イメージ センサーは、スペースが限られているポケット サイズの電話本体に収まる必要があるためです。 しかし、確かに遊びの余地はあります。 のような電話 ソニーのXperia Pro-I 2015 年の Panasonic CM1 パック 1 インチ カメラ センサーでさえ、大幅に改善されたダイナミック レンジと低照度での柔軟性を提供できるため、iPhone 14 内にはるかに大きなイメージ センサーを期待するのは、それほどワイルドではありません。

Panasonic の CM1 には 1 インチのイメージ センサーが搭載されており、2015 年に発売されました。

アンドリュー・ランクソン/ CNET

確かに、Apple はコンピューテーショナル フォトグラフィーで驚くべきことを行い、小さなセンサーからあらゆる品質を絞り出しますが、同じソフトウェア スキルを巨大なイメージ センサーと組み合わせると、その違いは非常に大きくなる可能性があります。 1 インチのイメージ センサーはもちろん問題外ではありませんが、多くのミラーレス カメラに見られるような APS-C サイズのセンサーで、Apple がさらに先を行くことを望んでいます。

そうですね、3つのカメラすべてが大規模なセンサーを搭載できるわけではありません.そうでなければ、単に電話に収まらないでしょう. それか、巨大なイメージ センサーを 1 つだけ搭載し、背面の回転ダイヤルにレンズを取り付けて、シーンに応じて視野角を物理的に変更できるようにします。 正直なところ、それは非常に Apple らしいことではないように思えます。

ついにSamsungに匹敵するズーム

一般的に、iPhone 13 Pro のメイン カメラで撮影した画像は、Galaxy S22 Ultra で撮影した画像よりも見栄えが良いと思いますが、Samsung が勝っている領域が 1 つあります。 望遠ズーム。 iPhone の光学ズームは最大 3.5 倍ですが、S22 Ultra は最大 10 倍の光学ズームを提供します。

そして、得られるショットの違いは驚くべきものです。 広角レンズを使用して目の前のすべてをキャプチャするのではなく、シーン内のあらゆる種類の隠された構図を見つけることができるズーム レンズが大好きです。 iPhone のズームは、これらの構図を得るのにある程度役立ちますが、S22 Ultra と競合するものではありません。

Galaxy S22 Ultra は 10 倍の素晴らしい光学ズームを備えており、Pixel 6 Pro でさえ 4 倍に対応しています。

アンドリュー・ランクソン/ CNET

したがって、携帯電話に必要なのは、デジタル トリミングやシャープニングだけでなく、優れた光学系に依存する適切なズーム レンズです。 少なくとも 2 つの光学ズーム レベルが必要です。 ポートレートの場合は 5 倍、より詳細な風景の場合は 10 倍です。 またはさらに良いことに、2 つの固定ズーム オプションから単純に選択するのではなく、これらのレベル間で連続的にズームして完璧な構図を見つけることができます。

個人的には、10 倍が Apple が必要とする最大値だと思います。 確かに、Samsung は実際にその電話が最大 100 倍までズームできることを誇っていますが、現実には、これらのショットはデジタル クロッピングに大きく依存しており、結果はひどいものです。 10x は巨大で、DSLR 用の 24-240mm レンズを持ち運ぶのと同等です。風景を一掃するのに十分な広さで、野生動物の写真にも十分なズームを備えています。 理想。

デフォルトのカメラアプリに組み込まれたプロビデオコントロール

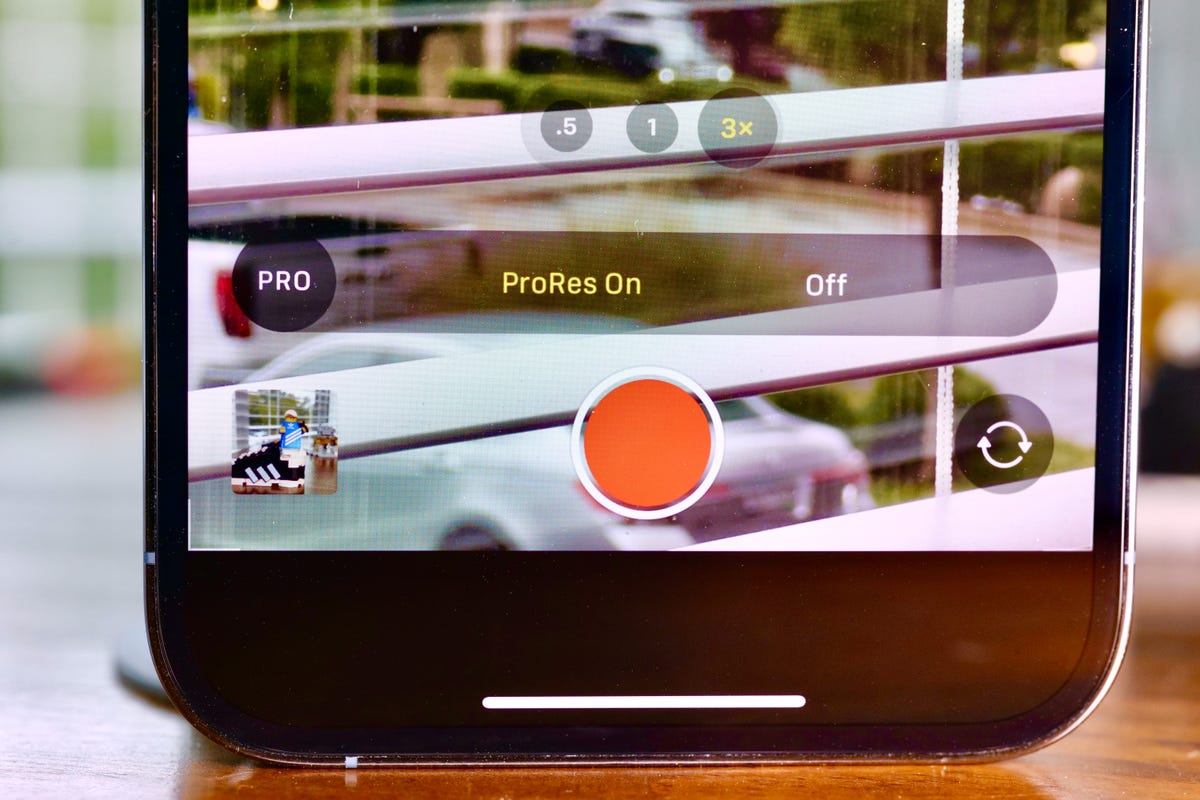

iPhone 13 Pro に ProRes ビデオを導入したことで、Apple は自社の携帯電話をプロのクリエイティブにとって真に役立つビデオ ツールと見なしているという強いシグナルを発しました。 ProRes は、大量のデータをキャプチャするビデオ コーデックであり、Adobe Premiere Pro などのポストプロダクション ソフトウェアでより多くの編集コントロールを可能にします。

ProRes はカメラ アプリに組み込まれているため、プロ ユーザー向けに他のコントロールを提供してみませんか?

パトリック・ホランド/CNET

しかし、カメラアプリ自体はまだかなり基本的なもので、ビデオ設定は主にProResのオン/オフ、ズームレンズの切り替え、解像度の変更に限定されています. それが要点です。 可能な限り簡単に撮影し、手間をかけずに美しい映像をキャプチャできるようにします。 しかし、ProRes を使用したいプロは、ホワイト バランス、フォーカス、シャッター スピードなどをより手動で制御したいと考えるでしょう。

そうです、だからこそ、Filmic Pro のようなアプリが存在し、これらすべての設定を信じられないほどきめ細かく制御して、思い通りの外観にすることができます。 しかし、Apple がこれらの設定をデフォルトのカメラ アプリ内でよりアクセスしやすくする方法を見つけてくれるとうれしいです。 そうすれば、ロック画面からカメラを起動し、いくつかの設定をいじるだけで、ビデオから望んでいたものを正確に得ていると確信して、すぐに始めることができます.

iPhone でのカメラ内フォーカス スタッキング

背後にそびえ立つアルプスの峰がある美しい山野草を見つけたと想像してみてください。 花に近づき、タップして焦点を合わせると、鮮明な視界に飛び込みます。 しかし、今は山に焦点が合っていません。タップすると、花がぼやけます。 これは、シーン内の遠く離れた 2 つのアイテムに焦点を合わせようとするときによくある問題であり、経験豊富な風景写真家やマクロ写真家は、フォーカス スタッキングと呼ばれる手法を使用して問題を解決します。

Canon R5 を使用して、ここで複数の画像を撮影し、その場でさまざまなポイントに焦点を合わせ、後でそれらを結合しました。 その結果、前から後ろまでピンとシャープな被写体が得られます。

アンドリュー・ランクソン/ CNET

フォーカス スタッキングとは、シーン内のさまざまな要素に焦点を合わせながら、カメラを動かさずに一連の画像を撮影することを意味します。 次に、これらの画像を後でブレンドし (通常は Adobe Photoshop などのデスクトップ ソフトウェアまたは Helicon Focus などのフォーカス専用ソフトウェアで)、極端な前景と背景に焦点を合わせた画像を作成します。 これは、芸術的な浅い被写界深度、つまり「ボケ」のために、被写体の周りの背景の焦点を意図的にぼかすことを試みるカメラのポートレート モードの反対の目標です。

ニッチな欲求かもしれませんが、このフォーカス スタッキング機能が iPhone に組み込まれているのを見てみたいです。 結局のところ、携帯電話はすでに画像ブレンディング技術を使用して、さまざまな露出を 1 つの HDR 画像に結合しています。露出ではなく、フォーカス ポイントのみを使用して、同じことを行っているだけです。

長時間露光での撮影がはるかに優れている

Apple は何年も前から、iPhone で長時間露光の画像を撮影する機能を持っていました。 それらのショットを見たことがあるでしょう。 水が巧みにぼやけている滝や川の画像ですが、水の周りの岩や風景は鮮明なままです。 これはシーンの動きを際立たせる優れたテクニックであり、私が自分のカメラと iPhone で行うのが大好きです。

iPhone 11 Proで撮影した標準露出と長時間露出の比較。 これは大変な作業ですが、その過程で多くの詳細が失われます。

アンドリュー・ランクソン/ CNET

iPhone では簡単に実行できますが、結果は問題ありません。 問題は、iPhone が動画 (ライブ フォト) を使用してシーン内の動きを検出し、デジタル処理でぼかしていることです。これは通常、次のことを意味します。 どれか 動きがぼやけます。あってはならない部分もぼやけます。 その結果、携帯電話を安定させるためにモバイル三脚に置いた場合でも、非常にどろどろしたショットになります. 家族に送ったり、Instagramに投稿したりするのには問題ありませんが、壁に印刷して額装すると見栄えが悪く、残念だと思います.

Apple が光学式手ぶれ補正をもっとうまく活用して、水だけでなく夜のシーン、おそらく通りを蛇行する車のヘッドライトなど、非常にシャープな長時間露光写真を可能にすることを望んでいます。 携帯電話からの写真でクリエイティブになり、それらのカメラの優れた品質を利用するもう1つの優れた方法です.