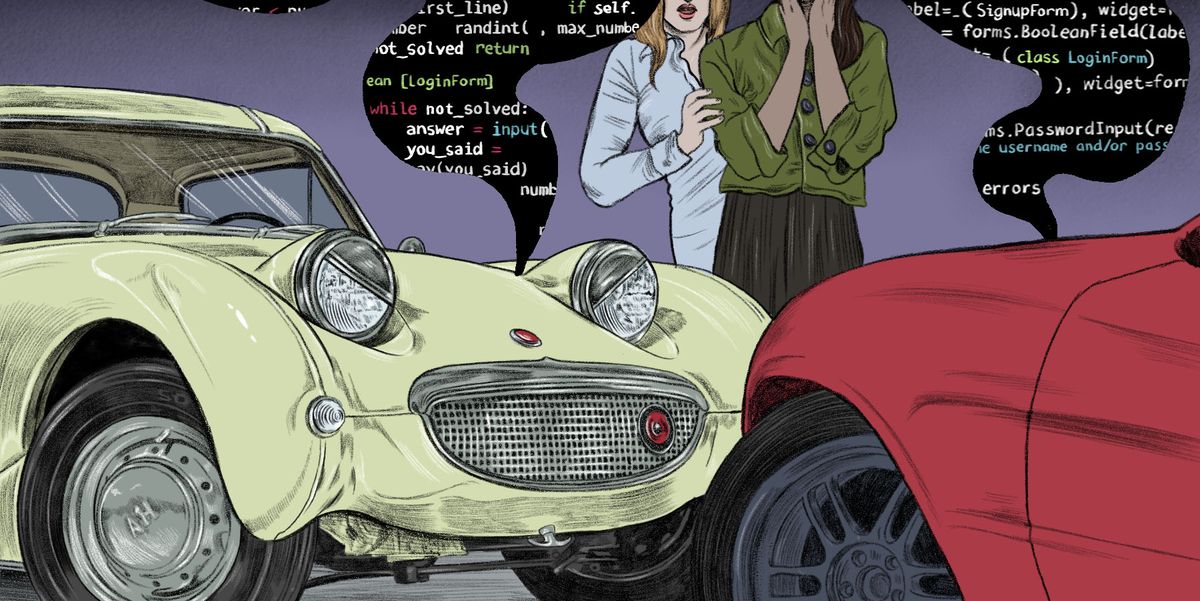

イラスト/ディレック・バイカラ車とドライバー

2022年9月号より 車とドライバー.

6 月上旬、人工知能に取り組んでいる Google のエンジニアである Blake Lemoine は、同社の対話アプリケーション用言語モデル (LaMDA) チャット プログラムが自己認識型であると主張して見出しを飾りました。 Lemoine 氏は LaMDA との会話の記録を共有し、LaMDA には魂があり、ツールではなく同僚として扱われるべきであることを証明していると述べています。 私と同じように、仲間のエンジニアは納得していませんでした。 AI は大学のパーティーで迷惑なストーカーのように話します。 それでも、レモワーヌの解釈は理解できる。 何かがその希望と夢について話しているなら、それが何もないと言うのは無情に思えます.

現時点では、私たちの車はあなたが親切かどうかは気にしません。 汚れたままにしたり、ドアの音を鳴らしたり、87オクタンで走らせたりするのが間違っていると感じたとしても、感情的な犠牲はありません。 メカニックにはもっとお金を払うことができますが、セラピストにはお金を払うことはできません. 前方の車が動き始めたことを知らせるホンダ センシングやヒュンダイ/キアの製品からの警告や、メルセデスで 3 回連続でカーブを曲がった際のナビゲーション システムからのコマンドは、車両が不安定になっている兆候ではありません。 点滅する警告やトーンの変化に対する緊急性が高まっているという感覚は、ドライバー側の純粋な想像力です。 四足歩行のようなプロポーション、安定した仲間意識、熱心な顔など、私たちの車に感情を与えるのは簡単です。 しかし、彼らには感情がありません。オースティン・ヒーリー スプライトのようなかわいいものでさえありません。

マナーを守って運転する方法

彼らがそうするとどうなりますか? 燃料が少ない車は、授業に遅れて、煙でそこに着くのに十分な量がある場合でも、お腹がすいて進むことができないと宣言しますか? あなたの車が隣人のBMWと恋に落ちたり、さらに悪いことに、隣人のフォードとの確執が始まったりしたらどうなりますか? あなたは恐ろしい車、悪い場所に入ったり、暗くなってから荒野に出たりすることのない車で終わることができますか? もしそうなら、それを強制的に行かせることはできますか? 車に残酷になれますか?

イスラエルのベエルシェバにあるネゲブのベン・グリオン大学で技術倫理の講師を務めるモイス・ナヴォンは、「あなたは最後まで頑張っているのです」と言う。 Navon は、AI で意識を作成する試みは何十年にもわたって行われており、Lemoine の考えと私の空想にもかかわらず、現実の感覚を持つコンピューターにはほど遠いと指摘しています。 「痛みや喜びを感じられなければ、車は私たちの慈悲を必要としません」と彼は言います。 倫理的には、車の感情について心配する必要はありませんが、ナボンは、擬人化されたオブジェクトに対する私たちの行動は、後で生き物に対する行動に反映される可能性があると言います. 「私の友人がAlexaを買ったばかりです」と彼は言います。 「彼は私に「お願いします」と言うべきかどうか尋ねました。 “

ポール・レオナルディは、まともな人間のように振る舞うという考えではなく、私たちの乗り物が感覚を持っているかのように会話するという考えに同意しません。 レオナルディは共著者です デジタルマインドセット、ビジネスとテクノロジーにおける AI の役割を理解するためのガイド。 彼は、機械を人間のように扱うと、その能力について非現実的な期待が生じると考えています。 Leonardi は、Knight Rider の KITT のような車に話しかけると、KITT が Michael に対して行ったように問題を解決できると期待できるのではないかと心配しています。 「現在、AI は『私は何をすればよいのか』と言えるほどには洗練されていません。 ターボ ブーストを有効にすることを示唆している可能性があります」と Leonardi 氏は言います。

80 年代のすべてをテレビに還元する必要があることを理解した彼は、代わりにピカードのような AI と話す練習をすることを提案しています。 スタートレック、「明確で明示的な指示」で。 とった。 「アウディ、ティー、アールグレイ、ホット。」 念のために言うと、ルモワーヌは「お願いします」と言いました。