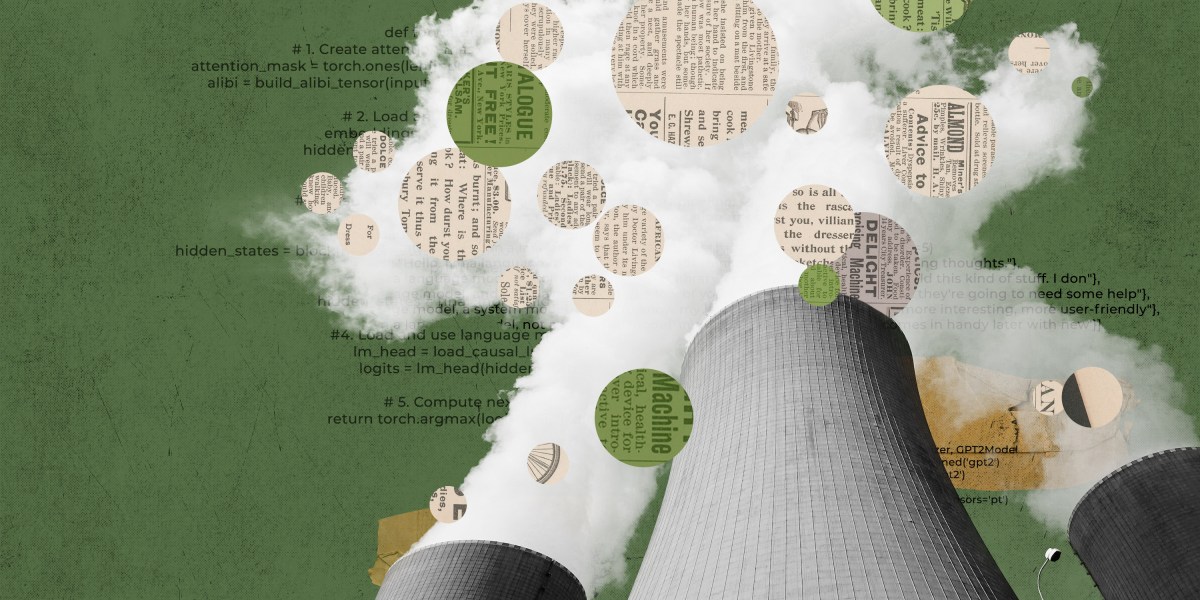

新しいアプローチをテストするために、Hugging Face は、今年初めに開始された独自の大規模言語モデル BLOOM の全体的な排出量を推定しました。 これは、スーパーコンピューターでモデルをトレーニングするために使用されるエネルギー量、スーパーコンピューターのハードウェアを製造してそのコンピューティング インフラストラクチャを維持するために必要なエネルギー、および BLOOM を実行するために使用されるエネルギーなど、さまざまな数値を合計するプロセスでした。展開されました。 研究者は、CodeCarbon と呼ばれるソフトウェア ツールを使用して、BLOOM が 18 日間にわたって生成した炭素排出量をリアルタイムで追跡して、最終的な部分を計算しました。

Hugging Face は、BLOOM のトレーニングによって 25 トンの二酸化炭素が排出されたと推定しています。 しかし、研究者は、トレーニングに使用されるコンピューター機器の製造、より広範なコンピューティング インフラストラクチャ、およびトレーニング後に BLOOM を実際に実行するために必要なエネルギーによって生成される排出量を考慮に入れると、その数値が 2 倍になることを発見しました。

1 つのモデルでは多量に思えるかもしれませんが、50 トンの炭素排出量は約 1 トンに相当します。 60便 ロンドンとニューヨークの間で、同じサイズの他の LLM に関連する排出量よりも大幅に少ないです。 これは、BLOOM がフランスのスーパーコンピューターでトレーニングされたためです。このスーパーコンピューターは、主に原子力を動力源としており、二酸化炭素を排出しません。 中国、オーストラリア、または化石燃料に依存するエネルギー グリッドを持つ米国の一部で訓練されたモデルは、より汚染度が高い可能性があります。

BLOOM の発売後、Hugging Face は、このモデルを使用して 1 日あたり約 19 キログラムの二酸化炭素を排出したと推定しました。 平均的な新車.

比較すると、OpenAI の GPT-3 そしてメタの オプト トレーニング中に、それぞれ 500 トン以上と 75 トン以上の二酸化炭素を排出すると推定されました。 GPT-3 の膨大な排出量は、古い効率の低いハードウェアでトレーニングされたという事実によって部分的に説明できます。 しかし、数字が何であるかを確実に言うのは難しいです。 炭素排出量を測定する標準化された方法はなく、これらの数値は外部の見積もりに基づいているか、Meta の場合は会社が発表した限られたデータに基づいています。

「私たちの目標は、トレーニング中に消費される電力の二酸化炭素排出量だけでなく、ライフサイクルの大部分を説明して、AI コミュニティが環境への影響とその影響についてよりよく理解できるようにすることでした。ハギング・フェイスの研究者で論文の筆頭著者であるサーシャ・ルッチョーニは言う。

Hugging Face の論文は、AI モデルを開発する組織に新しい基準を設定すると、カーネギー メロン大学のコンピューター サイエンス学部の助教授である Emma Strubell は述べています。 紙 2019 年の AI の気候への影響について。彼女はこの新しい研究には関与していません。

この論文は、「私が知る限り、大規模な ML モデルの二酸化炭素排出量について、これまでで最も徹底的で正直で知識豊富な分析を表しており、他のどの論文よりもはるかに詳細に説明しています。 [or] 私が知っている報告です」と Strubell は言います。