人間やった それを書いてください、またはChatGPT? それを判断するのは難しい場合があります。おそらく難しすぎると、その作成者である OpenAI は考えています。そのため、AI によって生成されたコンテンツに「透かし」を入れる方法に取り組んでいます。

で 講義 現在 OpenAI の客員研究員であるオースティン大学のコンピューター サイエンス教授 Scott Aaronson 氏は、OpenAI が「テキストの出力に統計的に透かしを入れる」ためのツールを開発していることを明らかにしました。 [AI system]」 システム (ChatGPT など) がテキストを生成するときはいつでも、ツールはテキストがどこから来たのかを示す「目立たない秘密の信号」を埋め込みます。

OpenAI エンジニアの Hendrik Kirchner が実用的なプロトタイプを作成した、と Aaronson は言います。それを将来の OpenAI で開発されたシステムに組み込むことを望んでいます。

「私たちはそれをより困難にすることを望んでいます [an AI system’s] 出力して、あたかもそれが人間からのものであるかのように伝えます」と Aaronson 氏は発言の中で述べています。 「これは明らかに学術的な剽窃を防ぐのに役立つかもしれませんが、例えばプロパガンダの大量生成を防ぐのにも役立ちます。モスクワに荒らしでいっぱいの建物さえもなしに、ロシアのウクライナ侵略を支持する一見トピックに沿ったコメントですべてのブログをスパム送信します。 または、誰かを非難するために誰かの文体になりすます。」

ランダム性の悪用

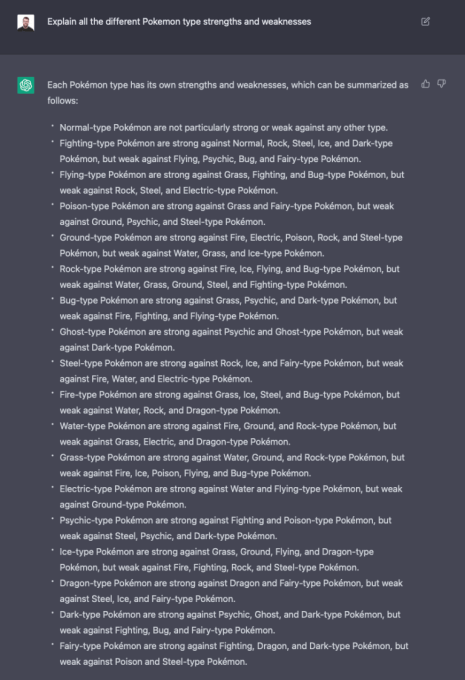

なぜ透かしが必要なのですか? ChatGPT はその好例です。 OpenAI によって開発されたチャットボットはインターネットを席巻し、難しい質問に答えるだけでなく、詩を書いたり、プログラミング パズルを解いたり、あらゆる哲学的トピックについて詩的になったりする能力を示しています。

ChatGPT は非常に面白く、そして本当に便利ですが、このシステムは明らかに倫理的な懸念を引き起こします。 それ以前の多くのテキスト生成システムと同様に、ChatGPT は高品質のフィッシング メールや有害なマルウェアを作成したり、学校の宿題でカンニングをしたりするために使用される可能性がありました。 また、質問応答ツールとしては、事実上一貫性がありません。プログラミング Q&A サイトの Stack Overflow が、ChatGPT からの回答を追って通知があるまで禁止する原因となった欠点です。

OpenAI の透かしツールの技術的基盤を把握するには、ChatGPT などのシステムが機能する理由を知ることが役立ちます。 これらのシステムは、入力テキストと出力テキストを「トークン」の文字列として認識します。これは、単語だけでなく、句読点や単語の一部でもあります。 システムの中核では、システムは確率分布と呼ばれる数学関数を常に生成して、以前に出力されたすべてのトークンを考慮して、出力する次のトークン (単語など) を決定します。

ChatGPT のような OpenAI がホストするシステムの場合、ディストリビューションが生成された後、OpenAI のサーバーはディストリビューションに従ってトークンをサンプリングするジョブを実行します。 この選択にはランダム性があります。 そのため、同じテキスト プロンプトでも異なる応答が得られる可能性があります。

OpenAI の透かしツールは、既存のテキスト生成システムの「ラッパー」のように機能し、サーバー レベルで実行されている暗号化機能を利用して次のトークンを「疑似ランダムに」選択するとアーロンソン氏は講演で述べました。 理論的には、システムによって生成されたテキストは、あなたや私にはランダムに見えますが、暗号化機能の「鍵」を持っている人なら誰でも透かしを明らかにすることができます.

「経験的に、数百のトークンは、はい、このテキストが [an AI system]. 原則として、長いテキストを取得して、どの部分が元になっている可能性があるかを特定することもできます [the system] そして、どの部分がおそらくそうではありませんでした。」 アーロンソンは言った。 「[The tool] 秘密鍵を使用して透かしを入れることができ、同じ鍵を使用して透かしを確認できます。」

主な制限事項

AI が生成したテキストに透かしを入れることは新しいアイデアではありません。 以前の試みは、ほとんどがルールベースで、同義語の置換や構文固有の単語の変更などの手法に依存していました。 しかし、理論の範囲外 リサーチ 昨年 3 月にドイツの研究所 CISPA によって公開された OpenAI は、この問題に対する最初の暗号ベースのアプローチの 1 つと思われます。

コメントを求めて連絡を取ったとき、アーロンソンは透かしのプロトタイプについての詳細を明らかにすることを拒否しました. OpenAI も拒否し、透かしは、AI によって生成された出力を検出するために調査しているいくつかの「来歴技術」の 1 つだとだけ言った.

しかし、無関係の学者や業界の専門家は、さまざまな意見を共有しました。 彼らは、このツールはサーバー側であり、必ずしもすべてのテキスト生成システムで機能するとは限らないことを指摘しています。 そして彼らは、敵対者が回避するのは些細なことだと主張している.

「言い換えたり、類義語を使用したりすることで、かなり簡単に回避できると思います」と、MITのコンピューターサイエンス教授であるSrini DevadasはTechCrunchに電子メールで語った. 「これはちょっとした綱引きです。」

Allen Institute for AI の研究科学者である Jack Hessel は、各トークンが個別の選択肢であるため、AI が生成したテキストをいつの間にかフィンガープリントするのは難しいと指摘しました。 フィンガープリントが明らかすぎると、奇妙な単語が選択されて流暢さが低下する可能性があります。

質問に答えるChatGPT。

OpenAI のライバルである AI21 Labs の共同創設者兼共同 CEO である Yoav Shoham は、統計的な透かしだけでは AI が生成したテキストのソースを特定するのに十分ではないと考えています。 彼は、テキストのさまざまな部分に異なる透かしを入れる差分透かしや、事実に基づくテキストのソースをより正確に引用する AI システムを含む、「より包括的な」アプローチを求めています。

この特定の透かし技術には、OpenAI に多くの信頼と力を与えることも必要である、と専門家は述べています。

「理想的なフィンガープリンティングは、人間のリーダーには識別できず、信頼性の高い検出を可能にします」と Hessel 氏は電子メールで述べています。 「セットアップ方法によっては、「署名」プロセスがどのように機能するかにより、OpenAI 自体が自信を持ってその検出を提供できる唯一の当事者である可能性があります。」

Aaronson 氏は講演の中で、OpenAI のような企業が最先端のシステムのスケールアップで先を行っており、責任あるプレーヤーであることに同意している世界でのみ、このスキームが実際に機能することを認めました。 OpenAI が透かしツールを Cohere や AI21Labs などの他のテキスト生成システム プロバイダーと共有したとしても、他のユーザーがそれを使用しないことを選択するのを妨げることはありません。

“もしも [it] すべての人が自由に使えるようになると、多くの安全対策が難しくなり、少なくとも政府の規制がなければ不可能になる可能性さえあります」とアーロンソンは言いました. 「誰でも同じくらい優れた独自のテキスト モデルを構築できる世界では、 [ChatGPT, for example] …そこで何をしますか?

これが、テキストから画像へのドメインでの実行方法です。 DALL-E 2 画像生成システムを API 経由でのみ利用できる OpenAI とは異なり、Stability AI はテキストから画像への技術 (Stable Diffusion と呼ばれる) をオープンソース化しました。 DALL-E 2 には API レベルで多数のフィルタがあり、問題のある画像が生成されるのを防ぎます (さらに、生成される画像に透かしが入ります) が、オープン ソースの Stable Diffusion にはありません。 悪意のある人物は、他の有毒なものの中でもとりわけ、ディープフェイク ポルノを作成するためにそれを使用しました。

アーロンソン氏は楽観的だ。 講演の中で彼は、OpenAI が透かしが機能し、生成されたテキストの品質に影響を与えないことを実証できれば、業界標準になる可能性があるとの信念を表明しました。

誰もが同意するわけではありません。 Devadas が指摘するように、このツールにはキーが必要です。つまり、完全にオープン ソースにすることはできず、OpenAI との提携に同意する組織への採用が制限される可能性があります。 (キーが公開されると、誰でも透かしの背後にあるパターンを推測でき、その目的が無効になります。)

しかし、それほど大げさではないかもしれません。 Quora の担当者は、同社はそのようなシステムの使用に関心があり、それが唯一のものではない可能性が高いと述べました。

「AI をスケーリングする際に安全で責任を持とうとすることについて心配するかもしれません…Google、Meta、Alibaba、その他の主要なプレーヤーの収益に深刻な打撃を与えるとすぐに、その多くは窓の外に消えてしまいます。 」 アーロンソンは言いました。 「一方で、私たちは過去 30 年間、大手インターネット企業が、訴えられることへの恐れや、責任あるプレーヤーとして見られたいという願望などの理由で、特定の最低限の基準に同意できることを目の当たりにしてきました。」