今年は AI にとって激動の年でした。 オンラインで多くの時間を過ごしたことがあれば、おそらく DALL-E 2 や Stable Diffusion などの AI システムによって生成された画像、または OpenAI の大規模言語モデル GPT の最新版である ChatGPT によって書かれたジョーク、エッセイ、またはその他のテキストに出くわしたことがあるでしょう。 -3.

画像やテキストが AI によって作成されたものであることが明らかな場合があります。 しかし、ますます、これらのモデルが生成する出力は、人間が作成したものであると簡単に思い込ませる可能性があります。 特に大規模な言語モデルは自信満々でたらめです。正しいように聞こえますが、実際には虚偽に満ちたテキストを作成します。

ほんの少しの楽しみであれば問題ありませんが、AI モデルを使用してフィルタリングされていない健康アドバイスを提供したり、他の形式の重要な情報を提供したりすると、深刻な結果を招く可能性があります。 AI システムはまた、誤った情報、悪用、スパムの大量の生成をばかげたほど簡単にしてしまい、私たちが消費する情報や現実感さえも歪めてしまう可能性があります。 たとえば、選挙に関しては特に心配になる可能性があります。

これらの簡単にアクセスできる大規模な言語モデルの急増は、重要な問題を提起します。オンラインで読んだものが人間によって書かれたものか機械によって書かれたものかをどのようにして知るのでしょうか? AI によって生成されたテキストを特定するために現在必要なツールを調べた記事を公開しました。 ネタバレ注意: 今日の検出ツール キットは、ChatGPT に対して非常に不十分です。

しかし、より深刻な長期的影響があります。 私たちは、でたらめの雪だるまの誕生をリアルタイムで目撃しているのかもしれません。

大規模な言語モデルは、インターネットからテキストをスクレイピングして構築されたデータセットでトレーニングされます。これには、人間がオンラインで書いた有毒、ばかげた、虚偽、悪意のあるすべてのものが含まれます。 完成した AI モデルは、これらの虚偽を事実として吐き戻し、その出力はオンラインのいたるところに広がっています。 テクノロジー企業は再びインターネットをスクレイピングし、AI で書かれたテキストをすくい上げて、より大きく説得力のあるモデルをトレーニングします。人間はそれを使用して、何度も何度もスクレイピングされる前に、さらにナンセンスを生み出すことができます。

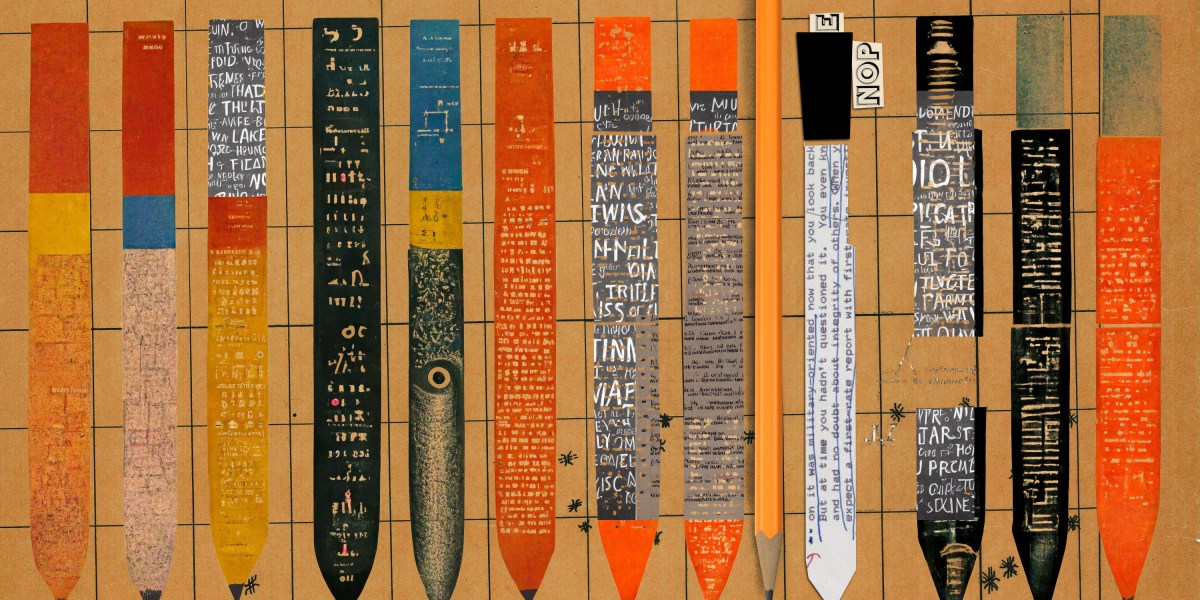

この問題 (AI が自らを食い物にし、ますます汚染された出力を生成する) は、画像にまで及びます。 「インターネットは現在、AI によって作成された画像で永遠に汚染されています」と、キングス カレッジ ロンドンの AI 研究者であるマイク クックは、私の同僚であるウィル ダグラス ヘブンに、生成 AI モデルの未来に関する新しい記事で語っています。

「2022年に作成した画像は、これから作成されるモデルの一部になります。」