新しい研究では、スタンフォード大学のチームは、運動皮質のニューロンが発話の動きに関する有用な情報も含んでいるかどうかを知りたいと考えていました。 つまり、「被験者 T12」が話そうとしたときに、口、舌、声帯をどのように動かそうとしたかを検出できたでしょうか?

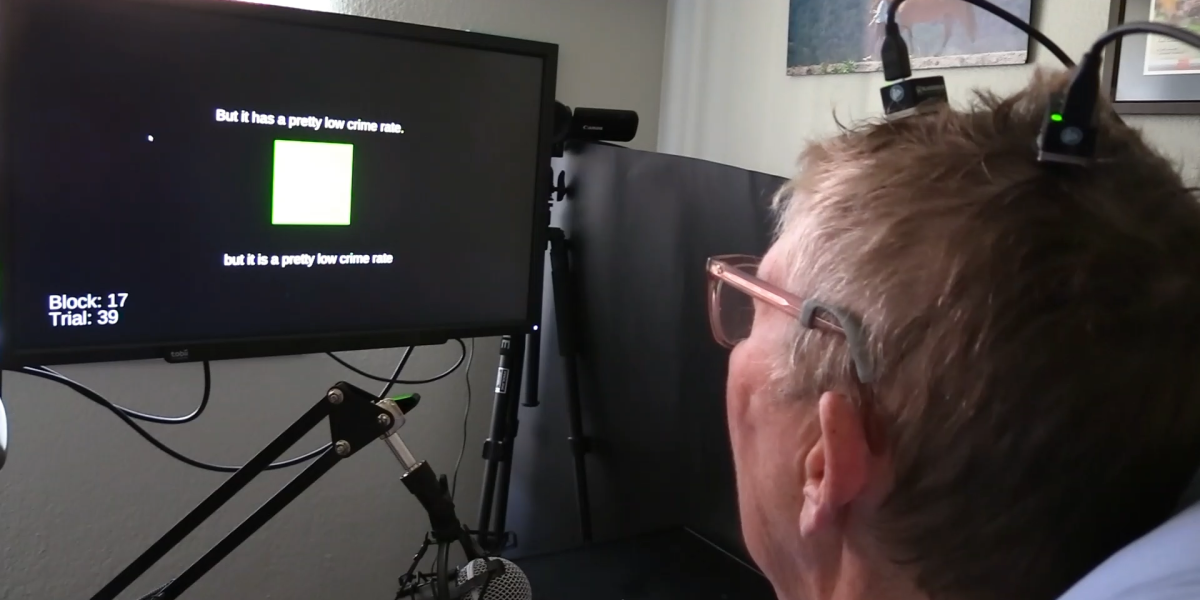

これらは小さく微妙な動きであり、サーベス氏によると、大きな発見の 1 つは、コンピューター プログラムが患者が何を言おうとしているかを正確に予測するのに十分な情報を、わずか数個のニューロンが含んでいたことです。 その情報は Shenoy のチームによってコンピューターの画面に伝えられ、コンピューターによって話されたとおりに患者の言葉が表示されました。

新しい結果は、カリフォルニア大学サンフランシスコ校のエドワード・チャンによる以前の研究に基づいています。 人が行う最も複雑な動き. 私たちは空気を押し出し、振動を加えて聞こえるようにし、口、唇、舌で言葉にします。 「f」という音を出すには、上の歯を下唇に当てて空気を押し出します。これは、話すために必要な数十の口の動きの 1 つにすぎません。

前進する道

Chang 氏はこれまで、ボランティアがコンピューターを通して話すことができるように、脳の上部に配置された電極を使用していましたが、プレプリントでは、スタンフォード大学の研究者は、システムの方が正確で、3 倍から 4 倍高速であると述べています。

「私たちの結果は、会話速度で麻痺を持つ人々へのコミュニケーションを回復するための実現可能な道を示しています」とシェノイと神経外科医のジェイミー・ヘンダーソンを含む研究者は書いています.

UCSF で Chang のチームと協力している David Moses は、現在の作業は「印象的な新しいパフォーマンス ベンチマーク」に達していると述べています。 しかし、記録が更新され続けているにもかかわらず、「複数年の時間スケールで安定した信頼できるパフォーマンスを示すことがますます重要になるでしょう」と彼は言います。 商用の脳インプラントは、特に時間の経過とともに劣化したり、記録の精度が低下したりした場合、規制当局を通過するのに苦労する可能性があります.

ウィレット、クンツ他

今後の道筋には、より高度なインプラントと人工知能とのより緊密な統合の両方が含まれる可能性があります。