— Tate Ryan-Mosley 氏、シニア テクノロジー ポリシー レポーター

私は常にスーパー Google 社員であり、不確実性に対処するために、何が起こるかについてできる限り多くのことを学ぼうと努めてきました。 その中には、父の喉頭がんも含まれていました。

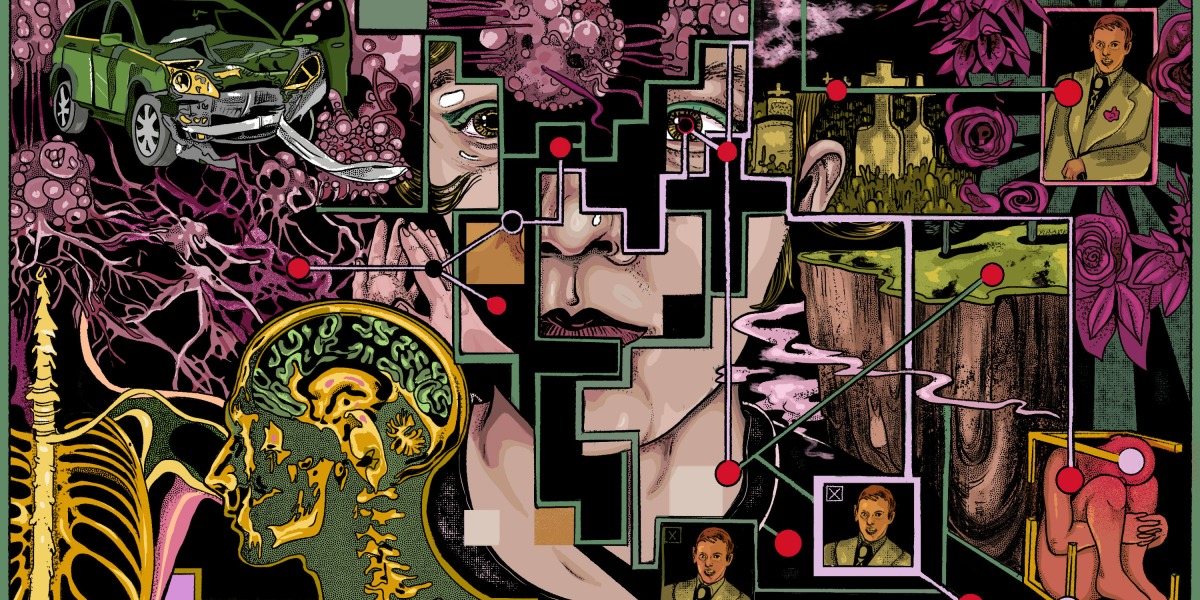

私は悲嘆の段階、喪失に関する書籍や学術研究を iPhone のアプリからグーグルで検索し始め、意図的または無意識に、Instagram の動画、さまざまなニュースフィード、Twitter の証言を通じて、人々の悲嘆と悲劇の経験を消費しました。

しかし、検索とクリックのたびに、私はうっかりしてデジタルの悲しみの網を張ってしまいました。 最終的には、アルゴリズムが私に提供しているものから自分自身を解き放つことはほとんど不可能であることが証明されます. 私は外に出ました—最終的に。 しかし、たとえそれが私たちにとって有害であっても、私たちが望まないコンテンツを購読解除したりオプトアウトしたりするのはなぜそれほど難しいのでしょうか? 全文を読む。

AI モデルが実在の人物の写真と著作権で保護された画像を吐き出す

ニュース: 新しい研究によると、画像生成モデルは、実在の人物の識別可能な写真、医療画像、およびアーティストによる著作権で保護された作品を生成するように促される可能性があります。

彼らがそれをした方法: 研究者は、Stable Diffusion と Google の Imagen に、人物の名前などの画像のキャプションを何度も追加しました。 次に、生成された画像のいずれかがモデルのデータベース内の元の画像と一致するかどうかを分析しました。 このグループは、AI のトレーニング セットから 100 を超える画像のレプリカを抽出することに成功しました。

重要な理由: この調査結果は、現在著作権侵害で AI 企業を訴えているアーティストの主張を強化する可能性があり、人間のプライバシーを脅かす可能性があります。 また、これらのシステムが機密性の高い個人情報を漏洩するリスクがあることを示しているため、ヘルスケアでジェネレーティブ AI モデルを使用したいスタートアップにも影響を与える可能性があります。 全文を読む。