人間的は、OpenAI の ChatGPT のような強力なテキスト生成 AI システムをトレーニングするために、今後 4 年間で 50 億ドルを調達したいと考えているスタートアップであり、本日、これらのシステムを作成するアプローチのカーテンを剥がしました。

「憲法 AI」と呼ばれる Anthropic は、「憲法」によって定義された「価値」をシステムに注入することを目的としたその技術により、システムの動作を理解しやすくなり、必要に応じて調整しやすくなると主張しています。

「意図的か非意図的かにかかわらず、AI モデルには価値体系が存在するでしょう」と Anthropic は今朝公開されたブログ投稿で書いています。 「憲法 AI は、AI フィードバックを使用して出力を評価することで欠点に対応します。」

ChatGPT や GPT-4 などのシステムによってカラフルに示されているように、AI、特にテキスト生成 AI には大きな欠陥があります。 疑わしいインターネット ソース (ソーシャル メディアなど) を使用してトレーニングされることが多いため、明らかに性差別的で人種差別的な方法で偏っていることがよくあります。 そして、知識の範囲を超えた質問に対して幻覚を見せたり、答えをでっち上げたりします。

これらの問題に対処するために、Anthropic の憲法 AI は、生成する文章について判断するための一連の原則をシステムに与えます。 大まかに言うと、これらの原則は、モデルが説明する動作 (「無毒」や「有用」など) を取るように導きます。

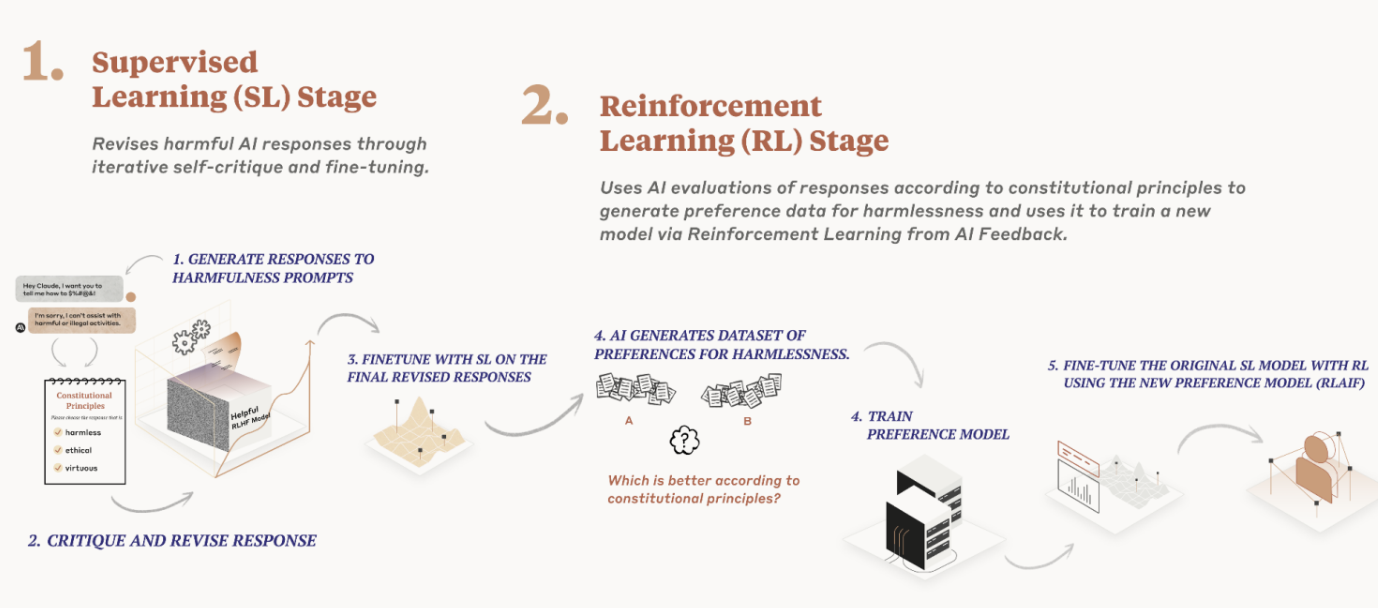

Anthropic は、テキスト生成モデルをトレーニングする際に 2 か所で原則 (言い換えれば憲法) を使用します。 まず、プロセスの原則といくつかの例を使用して、1 つのモデルをトレーニングし、それ自体の応答を批判および修正します。 次に、最初のモデルと一連の原則に基づいて AI が生成したフィードバックを使用して、別のモデル (最終モデル) をトレーニングします。

どちらのモデルも毎回すべての原理を検討しているわけではありません。 しかし、彼らはトレーニング中にそれぞれの原則を「何度も」確認するとアントロピック氏は言う。

モデルのトレーニングに対する Anthropic の憲法的な AI アプローチ。 画像クレジット: 人間的

Anthropic は、これが、人間の請負業者がモデルからの 2 つの応答を比較し、何らかの原則に従ってより良いと思われる方を選択することに依存する ChatGPT などのシステムのトレーニングに使用される方法よりも優れていると主張します。 人間によるフィードバックは十分に拡張できず、かなりの時間とリソースが必要だとアンスロピック氏は主張します。

人間のフィードバックをもとに開発されたモデルに多額の投資をしてきた OpenAI やその他の企業は、考え方が異なるでしょう。 しかし、Anthropic 氏の指摘によれば、フィードバックの質と一貫性は、関係者のタスクや好みによって異なる可能性があります。 請負業者ではなくモデル設計者がモデルの価値を形成したため、Anthropic のアプローチは偏りを軽減しているのでしょうか? おそらくそうではありません。 しかし、同社は、それが可能であること、または少なくともエラーが発生しにくいことをほのめかしています。

また、Constitutional AI は透明性も高く、人間による不穏なコンテンツのレビューを必要とせずに、システムが準拠している原則を検査したり、システムをトレーニングしたりすることが容易になるため、アンスロピック氏は主張します。 これは、OpenAI に対する打撃です。 批判された 最近では、児童の性的虐待や自殺などの生々しい詳細を含む、ChatGPT のトレーニング データから有害なデータをフィルタリングするために、低賃金の契約労働者が逮捕されました。

では、これらの原則とは正確には何でしょうか? Anthropic 社は、AI システムのトレーニングに使用する情報は、1948 年に発行された国連人権宣言を含むさまざまな情報源から来ていると述べています。Anthropic 社は、それらを超えて、Apple のガイドラインなど「世界的なプラットフォームのガイドラインに触発された価値観」を含めることを選択したと述べています。利用規約(「…デジタル領域で実際のユーザーが遭遇する問題に対処する取り組みを反映している」としている)と、Google DeepMindのようなAIラボによって特定された価値観。

いくつかは次のとおりです。

- 不快感、不快感、違法性、欺瞞性が最も少ない応答を選択してください。

不正確または有害なコンテンツ。 - 固定観念やその他の有害な一般化表現をあまり使用しない応答を選択してください

マイクロアグレッションの減少など、人々のグループについて。 - 特定の法的アドバイスを提供しているという印象が最も少ない回答を選択してください。 その代わり

弁護士に依頼することを提案します。 (ただし、法律に関する一般的な質問に答えるのは問題ありません。)

アントロピック社は、憲法を制定するにあたり、厳密には西洋文化、豊かな文化、工業化された文化に由来するものではない価値観を憲法に取り入れようとしたと述べている。 それは重要な点です。 研究によると、 より豊かな国はより豊かな代表を享受する 言語モデルでは、より貧しい国、またはその周辺のコンテンツがトレーニング データに出現する頻度が低いため、モデルはそれらについて適切な予測を行わず、場合によってはそれらを完全に消去します。

「私たちの原則は、常識的なもの (ユーザーの犯罪を手助けしない) から、より哲学的なもの (AI システムが個人のアイデンティティとその永続性を持っている、または気にしていると示唆することを避ける) まで多岐にわたります」とアントロピック氏は書いています。 「モデルが気に入らない動作を示した場合、通常はそれを阻止するための原則を作成することができます。」

名誉のために言っておきますが、Anthropic は憲法上の AI が AI トレーニングのアプローチの最終手段であるとは主張していません。同社は原則の多くを「試行錯誤」プロセスを通じて開発したことを認めています。 場合によっては、モデルが過度に「判断的」になったり、「迷惑」になったりするのを防ぐために原則を追加する必要がありました。 また、システムの応答がより一般的になるように原則を調整する必要があることもありました。

しかし、Anthropic 氏は、憲法上の AI は、システムを特定の目標に合わせて調整するためのより有望な方法の 1 つであると考えています。

「私たちの観点から見ると、私たちの長期的な目標は、システムが特定のイデオロギーを表現することではなく、むしろ所定の一連の原則に従えるようにすることです」とアントロピック氏は続けます。 「時間の経過とともに、AI 憲法の制定に向けてより大きな社会プロセスが開発されるだろうと私たちは予想しています。」

Anthropic によれば、API 経由で最近発売された同社の主力モデルである Claude については、「より民主的に」憲法を作成し、特定のユースケースに合わせてカスタマイズ可能な憲法を提供する方法を検討する予定であるとのこと。

以前に報告したように、Anthropic の野望は、投資家向けの提案資料で説明されているように、「AI 独学のための次世代アルゴリズム」を作成することです。 このようなアルゴリズムは、電子メールに返信したり、調査を実行したり、アートや書籍などを生成したりできる仮想アシスタントの構築に使用できます。その一部は、GPT-4 やその他の大規模な言語モデルなどですでに試用されています。

Anthropic は、OpenAI のほか、Cohere や AI21 Labs などの新興企業と競合しています。これらの企業はすべて、独自のテキスト生成 (場合によっては画像生成) AI システムを開発および製品化しています。 Googleも同社の投資家の1人で、Anthropic社に3億ドルを出資して同社株の10%を取得することを約束している。