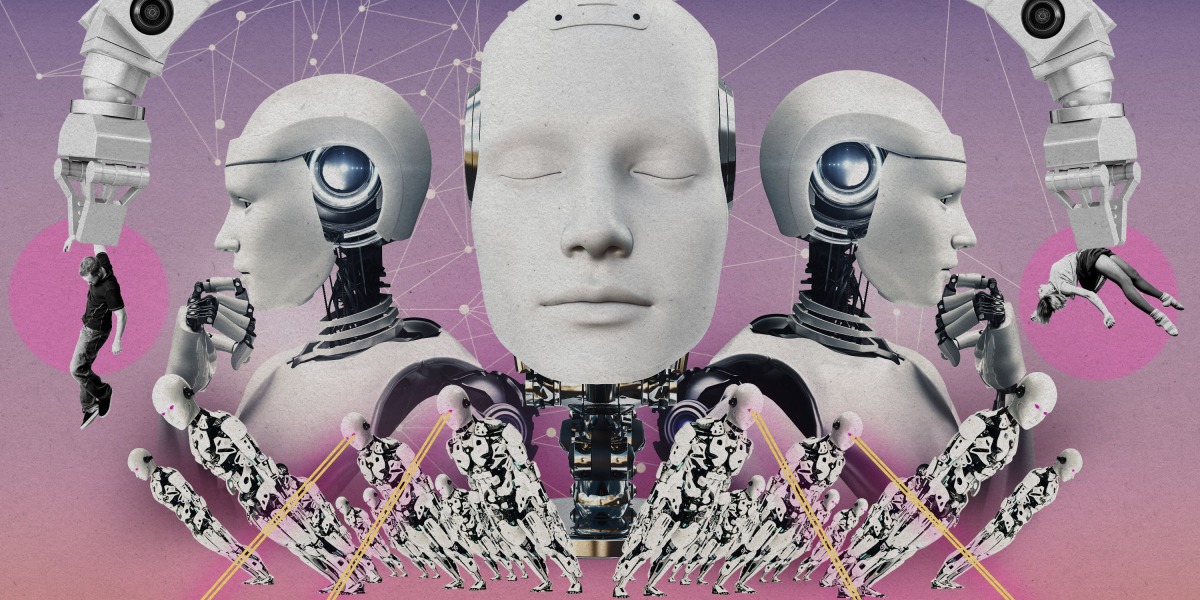

より深い学習

AI 時代における悪質なコンテンツの検出

過去 10 年間で、ビッグテックは言語、予測、パーソナライゼーション、アーカイブ、テキスト解析、データ処理などの分野で非常に優れています。 しかし、有害なコンテンツを捕捉し、ラベルを付け、削除することは依然として驚くほど下手です。 これが引き起こす現実世界の被害を理解するには、過去 2 年間に米国で選挙とワクチンに関する陰謀論が広がったことを思い出すだけで十分です。 生成 AI の使いやすさにより、より有害なオンライン コンテンツの作成が加速する可能性があります。 人々はすでに AI 言語モデルを使用して フェイクニュースサイト。

しかし、AI はコンテンツのモデレーションに役立つでしょうか? 最新の大規模言語モデルは、以前の AI システムよりもテキストの解釈がはるかに優れています。 理論的には、自動コンテンツモデレーションを強化するために使用できる可能性があります。 テート・ライアン・モズリーの詳細については、彼女の週刊ニュースレター「The Technocrat」をご覧ください。

ビットとバイト

科学者たちはAIを利用して薬剤耐性感染症と戦うことができる薬を発見した

MIT とマクマスター大学の研究者は、病院でよく見られる多くの薬剤耐性感染症の原因となるある種の細菌を殺すための新しい抗生物質を見つけることを可能にする AI アルゴリズムを開発しました。 これは、AI が科学的発見をどのように加速しサポートできるかを示すエキサイティングな開発です。 (マサチューセッツ工科大学ニュース)

サム・アルトマン氏、AIルールを巡ってOpenAIが欧州から撤退する可能性があると警告

同CEOは先週ロンドンで開かれたイベントで、OpenAIが次期AI法に準拠できない場合、EUでの「事業を停止」する可能性があると述べた。 アルトマン氏は、同社はAI法の文言に批判すべき点が多く、「可能なことには技術的な限界がある」と述べた。 これはおそらく空虚な脅しです。 ビッグテックがこう言うのを聞いたことがあります 以前に何度も 何らかのルールについて。 ほとんどの場合、世界第 2 位の貿易圏で収益を失うリスクが大きすぎるため、彼らは何とか策を講じます。 ここで明らかに注意しなければならないのは、多くの企業が中国で事業を行わないこと、あるいは中国でのプレゼンスを抑制することを選択していることだ。 しかし、それは非常に異なる状況でもあります。 (時間)

捕食者はすでに AI ツールを悪用して児童への性的虐待の資料を生成している

国立行方不明児童搾取センターは、捕食者が生成AIシステムを利用して偽の児童性的虐待資料を作成し、共有していると警告した。 強力な生成モデルが不十分でハッキングされやすい安全策を備えて展開されているため、このような事例が発生するのは時間の問題でした。 (ブルームバーグ)

技術者解雇により AI 倫理チームが荒廃

これは、Meta、Amazon、Alphabet、Twitter がインターネットの信頼性と安全性、および AI 倫理に焦点を当ててチームに対して行った大幅な削減の素晴らしい概要です。 たとえば、Meta は構築に半年かかったファクトチェック プロジェクトを終了しました。 企業が自社の製品に強力な AI モデルを展開しようと競っている一方で、経営陣は自社の技術開発が安全で倫理的であると自慢したがります。 しかし、ビッグテックがこれらの問題に専念するチームを費用がかかり消耗品であるとみなしていることは明らかです。 (CNBC)